Панельная дискуссия «ИИ для человечества: этика и безопасность ИИ в новую эпоху» в рамках Недели науки и технологий VinFuture 2025 объединяет ученых, политиков и изобретателей для обсуждения ответственного развития ИИ, ориентированного на гуманистические ценности.

В кулуарах дискуссии профессор Тоби Уолш из Университета Нового Южного Уэльса (Австралия), академик Американской ассоциации вычислительной техники рассказал об этичном и ответственном использовании ИИ.

Ответственное использование ИИ должно быть обязательным

- По мнению профессора, должно ли ответственное использование ИИ быть добровольным или обязательным? И как нам следует вести себя по отношению к ИИ?

Профессор Тоби Уолш: Я твёрдо убеждён, что ответственное использование ИИ должно быть обязательным. Сейчас существуют порочные стимулы, учитывая огромные деньги, зарабатываемые на ИИ, и единственный способ обеспечить надлежащее поведение — это ввести строгие правила, чтобы общественные интересы всегда были сбалансированы с коммерческими.

- Можете ли вы привести конкретные примеры ответственного и этичного применения ИИ из разных стран?

Профессор Тоби Уолш: Классическим примером являются решения с высокими ставками, такие как вынесение приговора и определение меры наказания в Соединенных Штатах, где система искусственного интеллекта используется для вынесения рекомендаций относительно срока тюремного заключения человека и вероятности повторного совершения им преступления.

К сожалению, эта система была обучена на исторических данных и непреднамеренно отражает прошлые расовые предрассудки, которые приводят к дискриминации чернокожих. Мы не должны позволять таким системам решать, кого посадить в тюрьму.

- Кто несёт ответственность, когда ИИ совершает ошибку? Есть ли у нас возможность исправить механизмы работы ИИ-агентов, особенно в случае с ними?

Профессор Тоби Уолш: Основная проблема ошибок ИИ заключается в том, что мы не можем привлечь ИИ к ответственности. ИИ — не человек, и это недостаток любой правовой системы в мире . Только люди несут ответственность за свои решения и действия.

Внезапно у нас появляется новый «агент», называемый ИИ, который может — если мы ему это позволим — принимать решения и совершать действия в нашем мире, что создает проблему: кого мы привлечем к ответственности?

Ответ заключается в том, чтобы привлечь компании, которые внедряют и эксплуатируют системы ИИ, к ответственности за последствия, вызываемые этими «машинами».

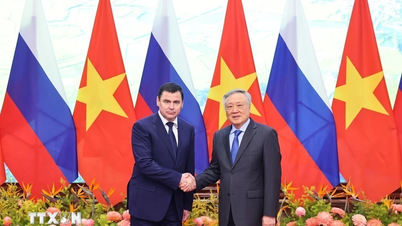

Профессор Тоби Уолш из Университета Нового Южного Уэльса выступил на семинаре «ИИ для человечества: этика и безопасность ИИ в новую эпоху» в рамках Недели науки и технологий VinFuture 2025. (Фото: Минь Сон/Vietnam+)

— Многие компании также говорят об ответственном ИИ. Как им можно доверять? Откуда мы знаем, что они серьёзны и всесторонне развивают свои идеи, а не просто используют «ответственный ИИ» как маркетинговый ход?

Профессор Тоби Уолш: Нам необходимо повысить прозрачность. Важно понимать возможности и ограничения систем искусственного интеллекта. Мы также должны «голосовать действием» — ответственно выбирать использование услуг.

Я искренне верю, что ответственное использование искусственного интеллекта станет фактором, определяющим конкурентные преимущества на рынке, и обеспечит компаниям коммерческое преимущество. Если компания уважает данные клиентов, это принесёт ей пользу и привлечёт новых клиентов.

Компании поймут, что поступать правильно не только этично, но и способствует их успеху. Я вижу в этом способ выделить компании, и ответственные компании — это те, с которыми нам комфортно вести бизнес.

«Если мы не будем осторожны, нас может ожидать период цифровой колонизации»

– Вьетнам – одна из немногих стран, рассматривающих возможность принятия Закона об искусственном интеллекте. Как вы оцениваете это? По вашему мнению, какие проблемы этики и безопасности при разработке ИИ существуют для развивающихся стран, таких как Вьетнам? Какие рекомендации профессор даёт Вьетнаму для достижения своих целей в стратегии развития ИИ – занять лидирующие позиции в регионе и мире по исследованиям и освоению ИИ?

Профессор Тоби Уолш: Я рад, что Вьетнам — одна из стран-первопроходцев, принявших специальный закон об искусственном интеллекте. Это важно, поскольку каждая страна имеет свои ценности и культуру, и ей необходимы законы, защищающие эти ценности.

Вьетнамские ценности и культура отличаются от австралийских, китайских и американских. Мы не можем ожидать, что китайские или американские технологические компании будут автоматически защищать вьетнамскую культуру и язык. Вьетнам должен взять на себя инициативу по защите этих ценностей.

Профессор Тоби Уолш предупреждает: если мы не будем осторожны, мы можем столкнуться с периодом цифровой колонизации. (Фото: Минь Сон/Vietnam+)

Я помню, что в прошлом многие развивающиеся страны прошли через период физической колонизации. Если мы не будем осторожны, нас может ожидать период «цифровой колонизации». Ваши данные будут эксплуатироваться, и вы станете дешёвым ресурсом.

Это окажется под угрозой, если развивающиеся страны будут развивать отрасль ИИ таким образом, чтобы эксплуатировать только данные, не контролируя и не защищая собственные интересы.

- Так как же выйти из этой ситуации, профессор?

Профессор Тоби Уолш: Всё просто: инвестируйте в людей. Повышайте квалификацию сотрудников, убедитесь, что они разбираются в ИИ. Поддерживайте предпринимателей, компании и университеты, работающие в сфере ИИ. Будьте проактивны. Вместо того, чтобы ждать, пока другие страны передадут нам технологии или направят нас, мы должны быть проактивны и владеть технологиями.

Что еще важнее, нам необходимо решительно выступать за создание платформами социальных сетей безопасной среды для пользователей во Вьетнаме, не нанося при этом ущерба демократии в стране.

На самом деле существует множество примеров того, как контент социальных сетей влиял на результаты выборов, разделял страны и даже подстрекал к терроризму.

— ИИ очень развит во Вьетнаме. В последнее время Вьетнам проводит множество политических мер по развитию ИИ, но Вьетнам также сталкивается с проблемой мошенничества, связанного с ИИ. Итак, по мнению профессора, как Вьетнаму следует действовать в этой ситуации?

Профессор Тоби Уолш: Для частных лиц, я думаю, самый простой способ — это проверить информацию. Например, когда мы получаем звонок или электронное письмо, например, из банка, нам нужно перепроверить информацию: мы можем перезвонить по этому номеру или связаться с банком напрямую, чтобы проверить информацию. В настоящее время существует множество поддельных электронных писем, телефонных номеров, даже звонки в Zoom можно подделать. Эти виды мошенничества очень просты, недороги и не занимают много времени.

В моей семье тоже есть своя мера безопасности: «секретный вопрос», который знают только члены семьи, например, имя нашего домашнего кролика. Это гарантирует, что важная информация останется в семье и не будет раскрыта.

- Большое спасибо./.

Профессор Тоби Уолш — почётный стипендиат ARC и профессор кафедры искусственного интеллекта (ИИ) в Университете Нового Южного Уэльса в Сиднее (UNSW). Он ярый сторонник установления ограничений, чтобы гарантировать, что ИИ будет использоваться для улучшения жизни людей.

Он также является членом Австралийской академии наук и включен в международный список «влиятельных людей в области искусственного интеллекта».

(Вьетнам+)

Источник: https://www.vietnamplus.vn/doanh-nghiep-su-dung-ai-co-trach-nhiem-se-mang-lai-loi-the-thuong-mai-post1080681.vnp

![[Фото] Поклонение статуе Тует Сон — почти 400-летнему сокровищу в пагоде Кео](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[Фото] Парад в честь 50-летия Национального дня Лаоса](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

Комментарий (0)