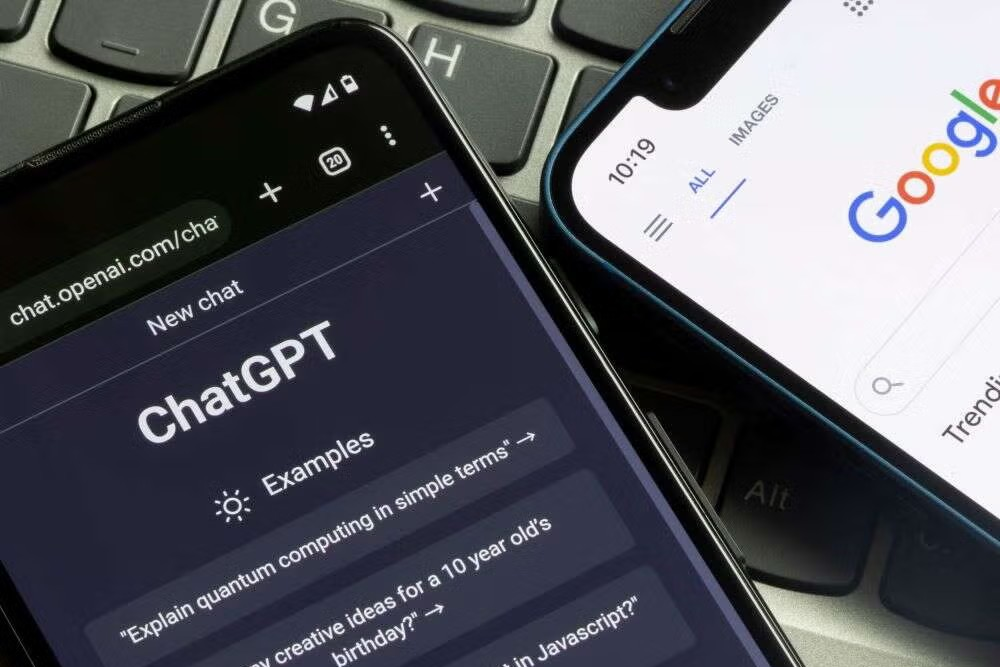

Eine neue Studie, die in der wissenschaftlichen Zeitschrift Proceedings of the National Academy of Sciences (PNAS) veröffentlicht wurde, zeigt, dass generative KI wie ChatGPT Arbeitnehmern zwar dabei helfen kann, Aufgaben schneller und effizienter zu erledigen, dies jedoch mit sozialen Kosten verbunden ist: Sie werden von anderen eher als faul, inkompetent oder hilflos angesehen.

Die von einem Team von Sozialwissenschaftlern durchgeführte Studie basiert auf der Attributionstheorie – der Annahme, dass Menschen dazu neigen, die Handlungen anderer eher auf deren intrinsischen Motivationen oder Fähigkeiten als auf die Umstände zu deuten. So wird beispielsweise das Bitten um Hilfe manchmal als Zeichen persönlicher Schwäche gewertet. Ebenso kann der Einsatz von KI eher als Mangel an Fähigkeiten oder Anstrengung denn als wirksames Mittel zur Effizienzsteigerung gewertet werden.

In vier Experimenten mit mehr als 4.400 Teilnehmern erzielte das Team bemerkenswerte Ergebnisse. Im ersten Experiment stellten sich die Teilnehmer vor, eine Aufgabe mithilfe von KI oder herkömmlichen Werkzeugen zu erledigen, und sagten dann voraus, wie sie von ihren Kollegen und Vorgesetzten beurteilt würden. Diese Personen befürchteten, als faul, ersetzbar und weniger fleißig zu gelten. Sie sagten, sie wollten ihren KI-Einsatz nicht öffentlich machen.

Ein zweites Experiment zeigte, dass dieser Bias tatsächlich existiert. Die Teilnehmer wurden gebeten, einen hypothetischen Mitarbeiter zu bewerten: einen, der KI nutzte, einen, der einen Kollegen um Hilfe bat, und einen, der es selbst tat. Die KI-Nutzer wurden als fauler, weniger kompetent, weniger fleißig und weniger unabhängig wahrgenommen als die beiden anderen Gruppen. Bemerkenswerterweise war diese Wahrnehmung unabhängig von Geschlecht, Alter oder Branche des abgebildeten Mitarbeiters konsistent.

Ein drittes Experiment untersuchte, ob diese Vorurteile tatsächliche Entscheidungen beeinflussten. Eine Gruppe von Teilnehmern fungierte als Personalvermittler und wählte Kandidaten danach aus, ob diese in ihrer Arbeit KI einsetzten oder nicht. Die Gruppe der Personalvermittler, die mit KI nicht vertraut waren, neigte dazu, Kandidaten auszuwählen, die auch keine KI nutzten. Umgekehrt fühlten sich diejenigen, die häufig KI nutzten, wohler und wählten eher Kandidaten aus, die KI nutzten. Dies deutet darauf hin, dass persönliche Erfahrungen mit der Technologie einen großen Einfluss auf die Einstellung der Bewerter haben.

In einem abschließenden Experiment untersuchte das Team, ob bestimmte Arbeitssituationen diese Voreingenommenheit verändern. Bei der Bearbeitung digitaler Aufgaben, wie dem Verfassen von E-Mails, wurden KI-Nutzer nicht als faul wahrgenommen und sogar höher bewertet. Bei manuellen Aufgaben, wie dem handschriftlichen Notizenmachen, wurden KI-Nutzer jedoch immer noch schlechter bewertet. Die Ergebnisse zeigten, dass die stärksten Voreingenommenheiten bei Aufgaben auftraten, die keine KI erforderten.

Interessanterweise neigten Teilnehmer, die zugaben, regelmäßig KI zu nutzen, weniger dazu, andere negativ zu beurteilen. Dies deutet darauf hin, dass Vertrautheit und praktische Erfahrung Stigmatisierung reduzieren können. Die Hauptautorin Jessica Reif, Doktorandin an der Fuqua School of Business der Duke University, sagte, sie habe das Projekt ins Leben gerufen, nachdem sie von Mitarbeitern gehört hatte, die Bedenken äußerten, beim Einsatz von KI beurteilt zu werden, obwohl ihre Arbeitsleistung nicht nachgelassen hatte.

Diese Studie weist methodische Stärken auf, wie beispielsweise sorgfältig konstruierte Kontrollsituationen. Der Autor räumt jedoch auch Einschränkungen ein, beispielsweise dass es sich bei den Situationen eher um hypothetische als um tatsächliche Beobachtungen handelt und dass die Bewerter die zu bewertenden Personen nicht direkt kennen, was in einer realen Arbeitsumgebung anders sein kann.

Diese Ergebnisse unterstreichen, dass KI zwar zu einem nützlichen Werkzeug zur Produktivitätssteigerung wird, ihr Einsatz aber auch die Auswirkungen auf das persönliche Image und den Ruf berücksichtigen muss. Die Forschungsergebnisse erinnern daran: Damit KI wirklich zu einem effektiven Assistenten wird, muss die Wahrnehmung im Arbeitsumfeld selbst geändert werden. KI-Nutzer dürfen nicht vorschnell als inkompetent oder faul abgestempelt werden. Arbeitnehmer sollten nicht nur wissen, wie sie die Technologie optimal nutzen können, sondern auch Transparenz wahren und gleichzeitig Fähigkeiten und persönliche Prägungen entwickeln, um nicht im von der KI geschaffenen Image zu verschwinden.

(Laut PsyPost)

Quelle: https://vietnamnet.vn/su-dung-chatgpt-trong-cong-vic-bi-danh-gia-luoi-bieng-kem-nang-luc-2422059.html

![[Foto] Der 1. Kongress des Parteikomitees der Provinz Phu Tho, Amtszeit 2025-2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/1507da06216649bba8a1ce6251816820)

![[Foto] Präsident Luong Cuong empfängt den Präsidenten der kubanischen Nationalversammlung, Esteban Lazo Hernandez](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/4d38932911c24f6ea1936252bd5427fa)

![[Foto] Panorama der Schrägseilbrücke, dem letzten Engpass der Ben Luc-Long Thanh-Schnellstraße](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/391fdf21025541d6b2f092e49a17243f)

Kommentar (0)