Según el Ministerio de Ciencia y Tecnología , siguiendo la tendencia general a nivel mundial, se evalúa que los sistemas de inteligencia artificial aporten grandes beneficios a las personas, la sociedad y la economía vietnamita, apoyando y resolviendo problemas complejos que enfrentan las personas y las comunidades. Paralelamente, es necesario investigar y adoptar medidas para minimizar los riesgos en el desarrollo y uso de la inteligencia artificial, así como para equilibrar los factores económicos, éticos y legales relacionados. Por lo tanto, los organismos especializados deben investigar y desarrollar normas y directrices que sirvan de guía, incluso si se trata de regulaciones flexibles y no vinculantes.

En las directrices, el Ministerio de Ciencia y Tecnología establece nueve principios en la investigación y el desarrollo de sistemas de inteligencia artificial responsables.

En primer lugar, el espíritu de cooperación y promoción de la innovación: los desarrolladores deben considerar la conectividad e interoperabilidad entre sus sistemas de IA y otros sistemas de IA considerando la diversidad de los sistemas para mejorar los beneficios del sistema y, al mismo tiempo, mejorar la coordinación para controlar los riesgos.

En segundo lugar, la transparencia: Los sistemas de inteligencia artificial que cumplen con este principio suelen ser sistemas que pueden afectar la vida, la integridad física, la privacidad o la propiedad de los usuarios o de terceros relacionados. En este caso, los desarrolladores deben prestar atención a la capacidad de identificar claramente las entradas y salidas del sistema, así como a la explicabilidad relacionada con las características de la tecnología aplicada y su uso para garantizar la confianza de la sociedad, incluidos los usuarios.

En tercer lugar, controlabilidad: Para evaluar los riesgos asociados a la controlabilidad del sistema, los desarrolladores deben realizar una evaluación previa para determinar si el sistema cumple con los requisitos y estándares técnicos pertinentes. Un método de evaluación de riesgos consiste en realizar pruebas en un espacio separado con medidas de seguridad antes de su aplicación práctica.

En cuarto lugar, el principio de seguridad: los desarrolladores deben garantizar que el sistema de inteligencia artificial no cause daños a la vida, el cuerpo o la propiedad de los usuarios o de terceros, incluso a través de intermediarios.

5. Principios de seguridad: Además de cumplir con los documentos, instrucciones e implementar las medidas de seguridad de la información según lo prescrito, los desarrolladores deben prestar atención a puntos como: confiabilidad y resistencia a ataques físicos o accidentes del sistema; confidencialidad; integridad; y disponibilidad de la información necesaria relacionada con la seguridad de la información del sistema...

6. Privacidad: Los desarrolladores deben garantizar que los sistemas de IA no violen la privacidad de los usuarios ni de terceros. La privacidad incluye la privacidad espacial (tranquilidad en la vida privada), la privacidad de la información (datos personales) y la confidencialidad de las comunicaciones. Los desarrolladores deben aplicar la normativa y las directrices vigentes; pueden consultar las normas y directrices internacionales sobre privacidad.

Los desarrolladores deben realizar una evaluación previa de los riesgos y el impacto en la privacidad. En la medida de lo posible, deben tomar medidas adecuadas a las características de la tecnología aplicada durante el proceso de desarrollo del sistema para evitar vulneraciones de la privacidad al implementarla.

Séptimo, respeto a los derechos humanos y la dignidad: Al desarrollar sistemas de inteligencia artificial que involucran a humanos, los desarrolladores deben tener especial cuidado en respetar los derechos humanos y la dignidad de las personas involucradas. En la medida de lo posible, dependiendo de las características de la tecnología aplicada, los desarrolladores deben tomar medidas para garantizar que no se produzcan discriminaciones ni injusticias debido al sesgo en los datos durante el entrenamiento del sistema.

Los desarrolladores deben tomar precauciones para garantizar que el sistema no viole los valores humanos y la ética social de acuerdo con los principios básicos de Vietnam (por ejemplo, valores que incluyen patriotismo, solidaridad, autosuficiencia, lealtad, honestidad, responsabilidad, disciplina, creatividad, etc.).

8º, soporte al usuario: Para apoyar a los usuarios, los desarrolladores de sistemas deben prestar atención a puntos como: Crear interfaces listas para proporcionar información oportuna y apropiada para ayudar a los usuarios a tomar decisiones y usarlo cómodamente; implementar medidas para que el sistema sea más fácil de usar para las personas vulnerables de la sociedad (los ancianos, los discapacitados)...

9. Responsabilidad: Los desarrolladores deben rendir cuentas de los sistemas que desarrollan para garantizar la confianza de los usuarios. En concreto, deben proporcionar a los usuarios información que les ayude a elegir y utilizar el sistema. Además, para aumentar la aceptación social de los sistemas, los desarrolladores deben hacer más: proporcionar a los usuarios información y descripciones de las especificaciones técnicas de los sistemas que desarrollan, algoritmos, mecanismos de seguridad, etc.; escuchar las opiniones y dialogar con las partes interesadas.

[anuncio_2]

Fuente: https://nhandan.vn/nghien-cuu-phat-trien-cac-he-thong-tri-tue-nhan-tao-co-trach-nhiem-post814609.html

![[Foto] Ceremonia de clausura del XVIII Congreso del Comité del Partido de Hanoi](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/17/1760704850107_ndo_br_1-jpg.webp)

![[Foto] Recogiendo residuos, sembrando semillas verdes](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/18/1760786475497_ndo_br_1-jpg.webp)

![[Foto] Sumérgete en el colorido mundo musical de “Secret Garden Live in Vietnam”](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/18/1760805978427_ndo_br_thiet-ke-chua-co-ten-41-png.webp)

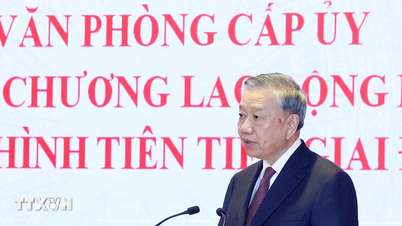

![[Foto] El Secretario General To Lam asiste al Día Tradicional del 95º Aniversario de la Oficina Central del Partido.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/18/1760784671836_a1-bnd-4476-1940-jpg.webp)

![[Foto] Sumérgete en el colorido mundo musical de “Secret Garden Live in Vietnam”](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/18/1760805978427_ndo_br_thiet-ke-chua-co-ten-41-png.webp)

![[Video] Alertan sobre estafas en llamadas de apoyo a damnificados por inundaciones](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/18/1760802081989_illustrated-natural-disasters-education-presentation-png.webp)

Kommentar (0)