|

| استرالیا با یک انتخاب روبرو است: ایجاد فعالانه قوانین هوش مصنوعی خود یا پایبندی به قوانین موجود. (منبع: The Interpreter) |

در این مقاله آمده است که هوش مصنوعی به عنوان یک پیشرفت جدید در حکومتداری و استراتژی ملی تبلیغ میشود. با این حال، اگر استرالیا قوانین خاص خود را برای این فناوری وضع نکند، این کشور به یک دریافتکننده منفعل تبدیل خواهد شد که به سیستمهایی که توسط کشورهای دیگر طراحی و کنترل میشوند، وابسته است.

مواجهه با یک مشکل دشوار

هوش مصنوعی یک فناوری خنثی نیست. نحوه عملکرد هوش مصنوعی، منعکس کننده طرز فکر، اولویتها و ارزشهای بازیگرانی است که آن را ایجاد میکنند، از جمله دولتها و شرکتهای خارجی.

واردات سیستمهای هوش مصنوعی ساخته شده با استانداردهای خارجی توسط استرالیا همچنین به معنای واردات قوانین مربوط به حریم خصوصی، استقلال و کنترل است. برای تضمین حاکمیت فناوری، استرالیا باید دستورالعملهای توسعه هوش مصنوعی و چارچوب حاکمیتی خود را توسعه دهد که به وضوح برای انعکاس ارزشها و منافع ملی طراحی شده باشد.

با این حال، مسئله این نیست که آیا از هوش مصنوعی استفاده شود یا خیر، بلکه مسئله این است که استرالیا تحت چه قوانینی این فناوری را اداره خواهد کرد. اگر استانداردها در خارج از کشور تدوین شوند، هر سیستم هوش مصنوعی که در استرالیا فعالیت میکند، توسط یک "رشته نامرئی" - نوعی وابستگی استراتژیک در عصر دیجیتال - محدود خواهد شد.

استرالیا نه ایالات متحده است و نه چین. این کشور نه میتواند در تولید سختافزار پیشرو باشد و نه میتواند هزینههای هنگفتی را صرف ساخت شبکههای پهپاد، ماهواره یا سیستمهای جنگ الگوریتمی کند.

با این حال، استرالیا هنوز یک انتخاب دارد: سرمایهگذاری در دانش برای ایجاد استانداردهای اخلاقی، حاکمیتی و قابلیت همکاری برای هوش مصنوعی، یا پذیرش استانداردهای تعیینشده توسط ایالات متحده یا چین. در این مورد، «مناسب بودن» اساساً به معنای وابستگی است.

در بخش دفاعی، برنامهریزان اغلب تواناییها را بر اساس تعداد دستگاهها یا قدرت فیزیکی ارزیابی میکنند. با این حال، هوش مصنوعی این مفهوم را تغییر داده است و اکنون قدرت با کنترل بر فرآیند تصمیمگیری سنجیده میشود.

استرالیا هنوز به هوش مصنوعی به عنوان کالایی برای خرید و ابزاری برای ارتقای قابلیتها نگاه میکند. اگر استانداردهای هوش مصنوعی همچنان توسط نهادهای خارجی تعیین شوند، هر سیستم هوش مصنوعی که کانبرا مستقر کند، با نخ نامرئی وابستگی به دنبال خود خواهد کشید.

بنابراین، استرالیا باید استانداردها و مقرراتی را در مورد قابلیت همکاری در دفاع، یک چارچوب شفافیت برای کاربرد در بخش دولتی و پادمانهای اخلاقی برای جلوگیری از سوءاستفاده از هوش مصنوعی برای دستکاری شهروندان یا تضعیف دموکراسی ایجاد کند.

اگر استرالیا بتواند به این هدف دست یابد و کشورهای دیگر را نیز به پیروی از خود وادارد، میتواند به یک تعیینکننده استاندارد تبدیل شود و در نتیجه قدرت نرم خود را تقویت کند، مشابه آنچه ژنو به عنوان مرکز حقوق بشردوستانه یا بروکسل به عنوان نماد حاکمیت جهانی حریم خصوصی در نظر گرفته میشوند.

چه مسیری در پیش روی استرالیا قرار دارد؟

سوال این است که آیا استرالیا ابتکار عمل را برای نوشتن قوانین بازی به دست خواهد گرفت یا از قوانینی که توسط سایر کشورها تعیین شده است، پیروی خواهد کرد؟

تحلیلگران معتقدند که استرالیا احتمالاً مسیر آسان را انتخاب خواهد کرد: تشکیل کمیتهها، نوشتن گزارشها و در نهایت خرید آنچه ایالات متحده در حال حاضر از آن استفاده میکند. این رویکرد ممکن است به عنوان «عملی بودن» پنهان شود، اما در واقع فقدان شجاعت در برنامهریزی استراتژیک است.

واضح است که استانداردهای هوش مصنوعی در حال حاضر در واشنگتن، بروکسل و پکن در حال شکلگیری هستند. اگر استرالیا با موضع روشنی به آنها نپیوندد، از همان ابتدا نامرئی خواهد شد.

استرالیا دو انتخاب بسیار واضح دارد: یا در شکلدهی به قوانین حق اظهار نظر داشته باشد، یا همچنان پیرو و تابع دستورات دیگران باقی بماند. وقتی این استانداردها تعیین شدند، میتوانند برای دههها پابرجا بمانند و نسلهای آینده استرالیاییها باید در چارچوبی زندگی کنند که هرگز انتخاب نکردهاند.

بنابراین، این فقط داستانی درباره «پیشی گرفتن از رقبا» یا «استفاده از فرصتها» نیست. این مسئله، مسئله حاکمیت و جایگاه است. استرالیا میتواند مانند گذشته به وابستگی خود ادامه دهد، یا میتواند نقش خود را در عصر هوش مصنوعی تعریف کند.

در این مقاله آمده است: «هوش مصنوعی یک روند گذرا نیست، بلکه سنگ بنای استراتژیک آینده است. کشورهای متوسطی مانند استرالیا شانس بسیار کمی برای تأثیرگذاری در عصر جدید دارند.»

منبع: https://baoquocte.vn/australia-dung-giua-nga-ba-duong-trong-linh-vuc-ai-330521.html

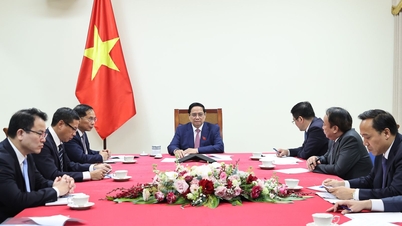

![[عکس] نخست وزیر فام مین چین با مدیرعامل شرکت روس اتم روسیه تماس تلفنی برقرار کرد.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[عکس] مراسم اختتامیه دهمین دوره مجلس شورای ملی پانزدهم](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

![[رسمی] گروه MISA از جایگاه پیشگام برند خود در ساخت هوش مصنوعی عاملی برای مشاغل، خانوارها و دولت خبر میدهد.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

نظر (0)