Il est nécessaire de réglementer les comportements interdits dans la recherche et l'application de l'IA.

L’intelligence artificielle (IA) s’impose comme la technologie de pointe de la quatrième révolution industrielle, offrant de nombreuses perspectives de développement socio -économique. Toutefois, elle soulève également des défis urgents en matière de gestion, d’éthique et de sécurité, défis que la réglementation actuelle ne couvre pas pleinement.

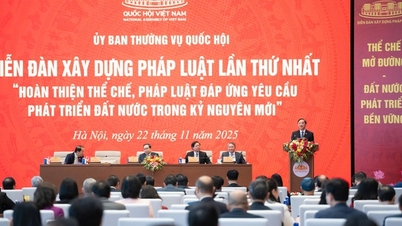

Par conséquent, les députés de l'Assemblée nationale se sont tous accordés sur la nécessité d'élaborer un projet de loi sur l'intelligence artificielle afin de créer un cadre juridique novateur pour l'intelligence artificielle, de créer un environnement juridique favorable à la promotion de l'innovation, d'améliorer la compétitivité nationale et, en même temps, de gérer les risques, de protéger les intérêts nationaux et les droits de l'homme.

Préoccupé par l'utilisation de l'IA dans les agences d'État, le député de l'Assemblée nationale Tran Dinh Chung (Da Nang) a déclaré que cela aiderait les agences, les fonctionnaires et les agents de la fonction publique à gagner beaucoup de temps, à traiter le travail plus rapidement et de manière plus synchrone, contribuant ainsi à améliorer la qualité du travail.

Outre les avantages en termes de coûts et de temps liés à l'application de l'IA dans les agences étatiques, les délégués ont également noté qu'il existe actuellement de nombreuses questions qui doivent être étudiées plus en détail et précisées dans le projet de loi.

Le premier problème concerne la sécurité lors de l'utilisation de l'IA, car les fonctionnaires doivent actuellement fournir des informations pour l'apprentissage de l'IA ainsi que lors de son fonctionnement. Par conséquent, en l'absence d'une gestion rigoureuse, il existe un risque que des données internes, des données sensibles ou des informations confidentielles de l'État soient intégrées au logiciel d'IA ou utilisées à des fins autres que l'apprentissage de l'IA. L'absence de réglementation spécifique concernant le stockage des données (modalités, lieux de stockage et droits d'accès) est également préoccupante.

Deuxièmement, la concentration d'une grande quantité de données provenant d'organismes étatiques dans des logiciels d'IA crée également un risque de piratage et de vol de données. Ce risque est d'autant plus important que les organismes étatiques ne peuvent concevoir et exploiter eux-mêmes de tels logiciels et dépendent souvent de la collaboration avec des entreprises externes. Parallèlement, le développement de logiciels espions étrangers expose également l'IA à un risque de vol et de prise de contrôle des données.

Troisièmement, un autre risque réside dans la précision. Les logiciels d'IA peuvent produire des résultats inexacts car ils apprennent à partir des données disponibles et peuvent hériter de biais ou de solutions erronées apportées par les fonctionnaires par le passé. « Des données inexactes ou incomplètes affectent considérablement la qualité de l'IA », a souligné le délégué.

Les responsables, les fonctionnaires et les citoyens ne possèdent pas les compétences nécessaires pour interroger l'IA, ce qui limite les réponses. Par ailleurs, l'IA a besoin de temps pour intégrer les nouveaux documents juridiques et les nouvelles directives des organismes d'État.

Quatrièmement, la qualité de l'IA actuelle ne répond pas aux exigences. Certains modèles d'IA sont très complexes, ce qui rend difficile le contrôle du processus d'analyse, le traitement des données et l'explication des décisions prises par l'IA. De plus, les erreurs inhérentes aux algorithmes ou aux systèmes d'IA sont également sources d'erreurs.

Outre les besoins en infrastructures techniques et en ressources humaines pour l'application de l'IA dans les agences gouvernementales, le délégué Tran Dinh Chung a également souligné la nécessité de se prémunir contre le risque de mésusage de cette technologie, qui pourrait entraîner une baisse des compétences des fonctionnaires. Ces derniers risquent de négliger la recherche, car ils pourraient être tentés de se contenter de la transformer en logiciel pour que l'IA contribue à répondre à leurs questions.

« L’utilisation de l’intelligence artificielle au sein des agences gouvernementales est une évolution inévitable. Cependant, la question de savoir comment l’utiliser pour garantir l’efficacité du travail tout en assurant la sécurité des informations reste posée. » C’est pourquoi le délégué Tran Dinh Chung a accepté de lancer le projet de loi sur l’intelligence artificielle, tout en suggérant de poursuivre son examen afin d’en assurer la cohérence avec les lois existantes.

Les délégués ont également proposé d'étudier et d'ajouter une disposition réglementant les comportements et activités interdits dans la recherche, l'application et l'adoption de l'IA, au lieu de les disperser dans de nombreuses dispositions du projet de loi comme c'est le cas actuellement, ce qui rend le contrôle difficile.

Selon le délégué, définir clairement la responsabilité juridique de l'IA est essentiel pour éviter les litiges futurs et traiter les infractions. Par ailleurs, l'IA étant liée aux machines et aux technologies, les erreurs humaines peuvent être imputées aux machines, aux technologies ou à d'autres facteurs. Il est donc indispensable de mener des recherches afin de définir précisément ces responsabilités et d'éviter toute confusion, notamment en ce qui concerne l'application et l'utilisation de l'IA au sein des organismes publics.

Il est nécessaire de définir clairement l'organisme chargé de la gestion des risques sur le terrain.

Préoccupée par la gestion des systèmes d'IA à haut risque, telle que définie à la section II, chapitre II du projet de loi, la députée Vuong Thi Huong (Tuyen Quang) a déclaré que le secteur de la santé devait être identifié comme l'un des secteurs à haut risque lors de l'application de l'intelligence artificielle, en raison de son impact direct sur la vie et la santé humaines, la sensibilité des données personnelles et la confiance du public. Les systèmes d'IA qui prennent en charge le diagnostic par imagerie, le traitement des maladies, la chirurgie, l'analyse génétique, etc., peuvent, en l'absence de contrôle, de normes de sécurité adéquates ou de transparence des données d'entraînement, entraîner des conséquences graves, voire irréversibles.

Le projet de loi prévoit la classification et la gestion des risques, mais ne précise pas l'organisme responsable de leur gestion dans chaque domaine spécifique. Par ailleurs, les délégués ont constaté que, dans le secteur de la santé, confier la coordination générale à l'agence de gestion des technologies de l'information sans définir clairement le rôle du secteur de la santé pourrait entraîner des chevauchements dans les évaluations, un manque d'uniformité des normes professionnelles et des difficultés de gestion des produits d'intelligence artificielle utilisés comme dispositifs médicaux ou appliqués aux examens et traitements médicaux.

Il est donc proposé de compléter la réglementation confiant au ministère de la Santé la gestion des systèmes d'intelligence artificielle à haut risque dans le domaine médical, de coordonner avec le ministère de l'Information et des Communications et les ministères et services concernés les mesures suivantes : promulguer des normes techniques, des évaluations cliniques et des contrôles de sécurité ; établir des réglementations sur la sécurité des données des dossiers médicaux et la connexion des systèmes d'information médicale ; et surveiller les risques liés à leur utilisation.

« Définir clairement le point central permettra de créer une base juridique solide, d’assurer la sécurité des patients et, en même temps, de créer les conditions nécessaires aux entreprises technologiques et aux établissements médicaux pour déployer des applications d’IA de manière transparente et contrôlée », a souligné la déléguée Vuong Thi Huong.

Approuvant les dispositions relatives au Fonds national de développement de l'intelligence artificielle figurant à l'article 23 du projet de loi, le député Be Minh Duc (Cao Bang) a déclaré que ce fonds avait été créé pour promouvoir et soutenir les capacités de recherche ainsi que les applications de l'IA dans le pays. Il a toutefois précisé que le pays dispose déjà du Fonds national de développement des sciences et des technologies et du Fonds national d'innovation technologique, qui visent également à soutenir la recherche et l'innovation technologique, notamment dans le domaine de l'IA.

Bien que la portée et les objectifs de chaque type de fonds diffèrent, ils sont tous axés sur les domaines scientifiques et technologiques. Il est donc recommandé d'examiner et de définir les liens entre les différents types de fonds afin d'optimiser leur efficacité, d'éviter les doublons, la dispersion des ressources et l'alourdissement du budget.

Bien qu'ils relèvent du même ministère de tutelle, les délégués ont suggéré qu'il était nécessaire d'envisager de combiner ces trois types de fonds, en concentrant les ressources sur la mise en œuvre de politiques de soutien pour un développement plus favorable de la science et de la technologie.

Par ailleurs, le délégué Be Minh Duc a également suggéré que les lois spécialisées pertinentes comportent des réglementations spécifiques sur l'IA dans chaque domaine. Il s'agit d'un principe qui doit être encadré, car notre pays entre dans l'ère numérique. L'intelligence artificielle a fait l'objet de nombreuses recherches et est appliquée dans tous les secteurs d'activité, tous les domaines socio-économiques, de défense et de sécurité. L'ajout de ce principe contribuera à assurer une réglementation complète des questions spécifiques et à répondre aux exigences de gestion dans le contexte actuel d'évolution technologique rapide.

Source : https://daibieunhandan.vn/gop-3-quy-ve-khoa-hoc-cong-nghe-giup-tap-trung-nguon-luc-10396526.html

Comment (0)