Les fausses photos de célébrités sont monnaie courante

Créer des images incroyablement réalistes, mais en réalité fausses, n'a jamais été aussi simple. Toute personne disposant d'une connexion internet et d'un outil d'IA peut créer des photos réalistes en quelques secondes, puis les diffuser sur les réseaux sociaux à une vitesse fulgurante.

Une fausse photo générée par l'IA prétend montrer Elon Musk « sortant avec » la PDG de GM, Mary Barra.

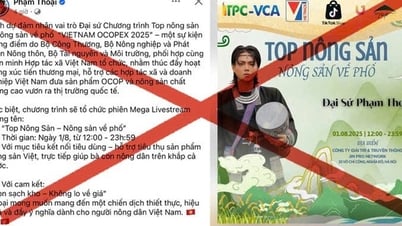

Ces derniers temps, nombre de ces images sont devenues virales : comme celle de l’ancien président Donald Trump et du président Vladimir Poutine faussement arrêtés ou celle du milliardaire Elon Musk « traînant » avec la PDG de General Motors (GM), Mary Barra.

Le problème est que les images générées par l'IA représentent des événements qui n'ont jamais eu lieu. Et même si certaines de ces images peuvent être drôles et paraître irréelles, les experts affirment qu'elles peuvent néanmoins présenter de réels dangers en termes de désinformation, voire de diffusion de fausses nouvelles.

Les images d'arrestations de personnalités politiques comme l'ancien président américain Donald Trump peuvent être vérifiées assez rapidement par les utilisateurs en consultant des sources médiatiques fiables. Cependant, l'expert en IA Henry Ajder a expliqué à DW que d'autres images sont plus difficiles à identifier, notamment celles où la personne photographiée n'est pas très célèbre.

Le danger des fausses photos d'événements

Selon Ajder, les images de personnes générées par l'IA ne sont pas les seules à pouvoir diffuser de fausses informations. Il a également cité des exemples d'utilisateurs ayant créé des événements qui n'ont jamais eu lieu, comme le tremblement de terre majeur qui aurait secoué les États-Unis et le Canada en 2001.

Mais le tremblement de terre n'a jamais eu lieu, et les images partagées sur Reddit ont toutes été générées par l'IA. Et c'est là, selon Ajder, le problème. « Si l'IA génère un paysage, il peut être plus difficile à repérer », explique-t-il.

Pourtant, les outils d'IA commettent des erreurs, même s'ils s'améliorent rapidement. En avril 2023, des programmes comme Midjourney, Dall-E et DeepAI présentaient tous des bugs, notamment avec les images montrant des humains.

Voici quelques conseils pour vérifier les images générées par l'IA, mais les experts ont rapidement averti qu'elles ne reflètent que la situation actuelle, car les outils d'intelligence artificielle évoluent chaque jour, voire chaque heure :

Zoomez et trouvez la source de l'image

De nombreuses images générées par l'IA semblent réelles au premier coup d'œil. C'est pourquoi les experts recommandent d'examiner la photo de plus près. Pour ce faire, recherchez la résolution la plus élevée possible, puis zoomez sur les détails.

Un zoom sur l’image révélera des incohérences et des erreurs qui peuvent passer inaperçues au premier coup d’œil.

Si vous n'êtes pas sûr qu'une image soit réelle ou générée par l'IA, essayez de rechercher sa source. Vous pouvez obtenir des informations sur l'endroit où l'image a été publiée à l'origine en lisant les commentaires des autres utilisateurs sous l'image.

Vous pouvez également effectuer une recherche d'image inversée. Pour cela, téléchargez l'image sur des outils comme Google Image Reverse Search, TinEye ou Yandex et vous pourrez retrouver sa source originale.

Les résultats de ces recherches peuvent également afficher des liens vers des vérifications de faits effectuées par des médias réputés qui fournissent un contexte supplémentaire.

Faites attention aux proportions du corps et aux erreurs d'affichage

Il n'est pas rare que les images générées par l'IA présentent des différences de proportions. Les mains peuvent être trop petites ou les doigts trop longs. La tête et les jambes peuvent également ne pas correspondre au reste du corps.

Les mains constituent actuellement une source majeure d'erreurs dans les programmes d'imagerie par IA comme Midjourney ou DALL-E. Les personnes ont souvent des doigts supplémentaires ou manquants, comme sur les fausses photos du pape François.

Fausse photo du pape François générée par l'IA.

D'autres erreurs fréquentes dans les images générées par l'IA incluent des personnes présentant trop de dents, des lunettes de forme étrange ou des oreilles aux formes irréalistes. Les surfaces réfléchissantes, comme les visières de casque, posent également problème aux programmes d'IA.

Cependant, l'expert en IA Henry Ajder prévient que les nouvelles versions de programmes comme Midjourney s'améliorent dans la génération de mains, ce qui signifie que les utilisateurs ne pourront pas compter longtemps sur eux pour détecter ces types d'erreurs.

L'image semble-t-elle fausse et lisse ?

L'application Midjourney, en particulier, produit des images si belles et si parfaites que les spectateurs doivent se poser des questions. « Les visages sont trop purs, les tissus trop harmonieux », explique Andreas Dengel, du Centre allemand de recherche en IA.

Sur de nombreuses images IA, la peau des personnes est souvent lisse et sans défaut, et même leurs cheveux et leurs dents sont parfaits. C'est impossible dans la réalité.

De nombreuses photos sont artistiques, brillantes et étincelantes, ce que même les photographes professionnels ont du mal à obtenir lorsqu'ils prennent des photos en studio.

Les outils d’IA semblent souvent concevoir des images idéales censées être parfaites et plaire au plus grand nombre de personnes possible.

Vérifiez le contexte et la conclusion

L'arrière-plan d'une image peut souvent révéler qu'elle a été truquée. Les objets peuvent être déformés, comme les lampadaires. Dans certains cas, les programmes d'IA copient des personnes et des objets et les réutilisent à l'infini. Il n'est pas rare que l'arrière-plan d'une image IA soit flou.

Mais même ce floutage peut être imparfait. Comme celui qui devait montrer un Will Smith en colère aux Oscars. L'arrière-plan était non seulement flou, mais aussi artificiellement flou.

De nombreuses images générées par l'IA peuvent désormais être détectées d'un simple coup de main. Des outils de détection comme Hugging Face peuvent également vous aider à repérer les contrefaçons. Mais à mesure que la technologie s'améliore, les défauts des images générées par l'IA pourraient devenir moins évidents, les rendant plus difficiles à repérer.

Hoang Hai (selon DW)

Source

Comment (0)