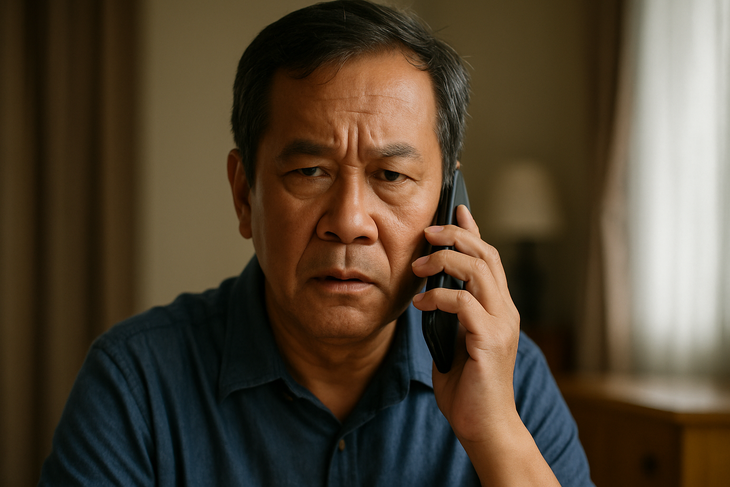

Penipuan yang melibatkan peniruan suara dengan suara deepfake.

Di era kecerdasan buatan yang berkembang pesat, suara – yang dulunya dianggap sebagai bukti yang dapat diandalkan – kini telah menjadi alat berbahaya di tangan para penjahat. Teknologi suara deepfake memungkinkan pembuatan suara yang hampir tidak dapat dibedakan dari suara orang sungguhan, sehingga memungkinkan panggilan penipuan canggih yang bertujuan untuk menipu dan mencuri aset.

Mengapa suara deepfake terdengar begitu menakutkan?

Deepfake voice adalah teknologi yang menggunakan kecerdasan buatan (AI) dan pembelajaran mesin untuk menciptakan suara palsu yang terdengar persis seperti suara orang sungguhan.

Dengan bantuan model modern seperti Tacotron, WaveNet, ElevenLabs, atau platform kloning suara seperti Reppeecher, para penjahat hanya membutuhkan sampel suara selama 3-10 detik untuk membuat deepfake yang 95% meyakinkan.

Suara deepfake sangat berbahaya karena kemampuannya meniru ucapan hampir sempurna, mulai dari pengucapan dan intonasi hingga pola bicara unik setiap individu.

Hal ini membuat korban sangat sulit membedakan antara suara asli dan suara palsu, terutama ketika suara tersebut milik kerabat, teman, atau atasan.

Memanfaatkan rekaman suara juga sangat mudah, karena saat ini kebanyakan orang memaparkan audio mereka melalui platform seperti TikTok, siaran langsung media sosial, podcast, atau pertemuan daring. Yang lebih mengkhawatirkan, suara deepfake tidak meninggalkan jejak visual seperti gambar atau video , sehingga menyulitkan penyelidikan dan korban mudah kehilangan uang.

Deepfake dapat dibuat hanya dengan beberapa detik sampel suara.

Penipuan suara deepfake semakin canggih, seringkali menggunakan skrip yang familiar: meniru kenalan dalam situasi darurat untuk menciptakan kepanikan dan menekan korban agar segera mentransfer uang.

Di Vietnam, terdapat kasus di mana para ibu menerima telepon dari "anak laki-laki mereka" yang mengaku mengalami kecelakaan dan sangat membutuhkan uang. Di Inggris, seorang direktur perusahaan ditipu hingga kehilangan lebih dari $240.000 setelah mendengar "bosnya" meminta transfer uang melalui telepon. Seorang karyawan administrasi juga tertipu ketika menerima telepon dari "bos senior" yang meminta pembayaran untuk "mitra strategis"...

Kesamaan dalam situasi ini adalah suara palsu tersebut direproduksi agar terdengar persis seperti suara kerabat atau atasan, sehingga korban langsung mempercayainya dan tidak punya waktu untuk memverifikasi.

Selalu verifikasi, jangan langsung percaya.

Mengingat meningkatnya penipuan suara deepfake, masyarakat disarankan untuk tidak mentransfer uang hanya berdasarkan panggilan suara, meskipun suara tersebut terdengar persis seperti kerabat. Sebaliknya, hubungi kembali nomor asli atau verifikasi informasi melalui beberapa saluran sebelum melakukan transaksi apa pun.

Banyak ahli juga merekomendasikan untuk membuat "kata sandi internal" di dalam keluarga atau bisnis untuk verifikasi dalam situasi yang tidak biasa.

Selain itu, perlu untuk membatasi pengunggahan video dengan audio yang jelas ke media sosial, terutama konten yang berdurasi panjang. Secara khusus, peringatan dan panduan proaktif harus diberikan kepada kelompok rentan seperti lansia atau mereka yang memiliki akses terbatas ke teknologi, karena mereka adalah target utama penipuan teknologi tinggi.

Suara keluarga, teman, dan kolega semuanya bisa dipalsukan.

Di banyak negara, pihak berwenang telah mulai memperketat regulasi teknologi deepfake melalui kerangka hukum mereka sendiri.

Di AS, beberapa negara bagian telah melarang penggunaan deepfake dalam kampanye pemilihan atau untuk menyebarkan informasi yang salah. Uni Eropa (UE) telah mengesahkan Undang-Undang AI, yang mewajibkan organisasi untuk bersikap transparan dan memberikan peringatan yang jelas jika konten dibuat menggunakan kecerdasan buatan.

Sementara itu, di Vietnam, meskipun tidak ada peraturan khusus untuk suara deepfake, tindakan terkait dapat dituntut berdasarkan hukum yang berlaku, dengan tuduhan seperti penipuan, pelanggaran privasi, atau peniruan identitas.

Namun, kenyataannya teknologi berkembang dengan kecepatan yang jauh melebihi kapasitas pengawasan hukum, sehingga meninggalkan banyak celah yang dapat dieksploitasi oleh pihak-pihak yang berniat jahat.

Ketika suara bukan lagi bukti

Dahulu, suara sering dikaitkan erat dengan bukti yang dapat diandalkan, tetapi dengan suara deepfake, suara tidak lagi menjadi bukti yang dapat dipercaya. Di era AI, individu membutuhkan pengetahuan pertahanan digital, verifikasi proaktif, dan kewaspadaan terus-menerus karena sebuah panggilan bisa jadi jebakan.

Sumber: https://tuoitre.vn/lua-dao-bang-deepfake-voice-ngay-cang-tinh-vi-phai-lam-sao-20250709105303634.htm

![[Gambar] Tampilan dekat "jalan suci" yang baru ditemukan di My Son Sanctuary](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F13%2F1765587881240_ndo_br_ms5-jpg.webp&w=3840&q=75)

Komentar (0)