|

OpenAIのチャットボットは、新しいテクノロジーを通じて常に進化を続けています。写真:ニューヨーク・タイムズ |

2024年9月、OpenAIは、数学、 科学、コンピュータープログラミングに関連するタスクで推論が可能な、o1モデルを統合したAIのバージョンであるChatGPTをリリースしました。

ChatGPT の以前のバージョンとは異なり、新しいテクノロジーでは、応答を提供する前に、複雑な問題に対する解決策について「考える」のに時間がかかります。

OpenAIに続き、Google、Anthropic、DeepSeekといった多くの競合他社も同様の推論モデルを導入しています。完璧ではありませんが、これは多くの開発者が信頼するチャットボットのアップグレード技術です。

AIの推論方法

本質的に、推論とは、チャットボットがユーザーから提示された問題の解決に多くの時間を費やせることを意味します。

「推論とは、システムが質問を受け取った後に追加の作業を実行する方法です」とカリフォルニア大学のコンピューターサイエンス教授ダン・クライン氏はニューヨーク・タイムズに語った。

推論システムは、問題を多くの個別のステップに分解したり、試行錯誤を通じて解決したりすることができます。

ChatGPTはリリース当初、情報を抽出・統合することで質問に即座に回答できました。一方、推論システムでは、問題を解決して回答を提供するまでに数秒(場合によっては数分)もかかりました。

|

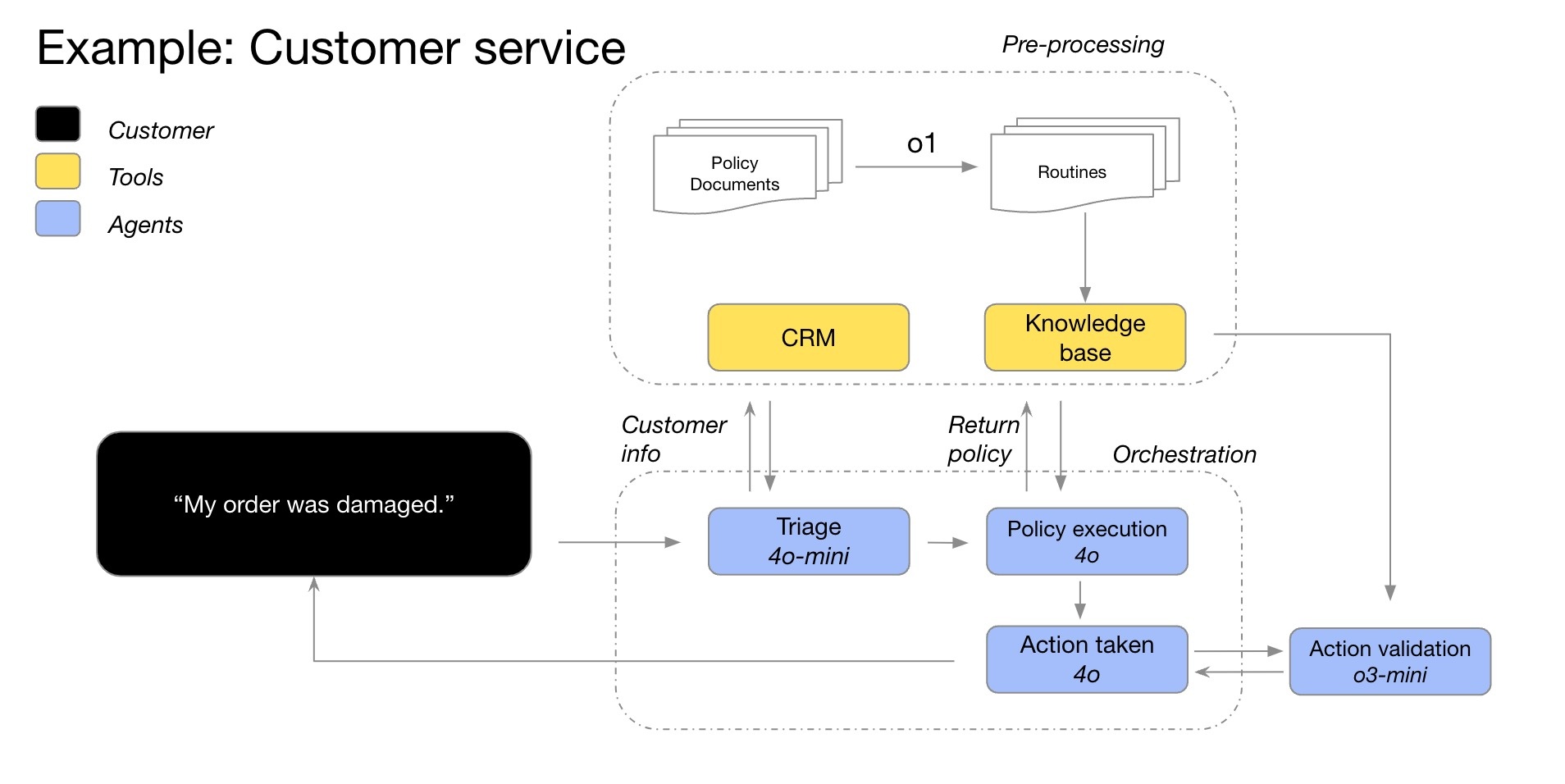

カスタマーサービスチャットボットにおけるO1モデルの推論プロセスの例。画像: OpenAI 。 |

場合によっては、推論システムは問題へのアプローチを変更し、解決策を継続的に改善します。さらに、モデルは最適な選択を行う前に複数の解決策をテストしたり、以前の回答の精度を確認したりする場合もあります。

一般的に、推論システムは質問に対するあらゆる可能な答えを考慮します。これは、小学生が数学の問題で最も適切な答えを選ぶ前に、紙に多くの選択肢を書き出すのと似ています。

ニューヨーク・タイムズによると、AIは今やほぼあらゆるトピックについて推論できる能力を持っている。しかし、最も効果を発揮するのは数学、科学、そしてコンピュータープログラミングに関する質問だろう。

理論システムはどのように訓練されるのでしょうか?

一般的なチャットボットでは、ユーザーはプロセスの説明を求めたり、応答の正確性を確認したりすることができます。実際、多くのChatGPTトレーニングデータセットには、問題解決手順が既に含まれています。

推論システムは、ユーザーの入力なしに操作を実行できるようになると、さらに高度になります。このプロセスはより複雑で広範囲にわたります。企業が「推論」という言葉を使用するのは、このシステムが人間の思考に似た動作をするためです。

OpenAIをはじめとする多くの企業は、推論システムが現在利用可能なチャットボットの改善に最適なソリューションになると考えています。長年にわたり、彼らはチャットボットはインターネット上でより多くの情報で訓練されるほど、パフォーマンスが向上すると信じてきました。

2024年までに、AIシステムはインターネット上のほぼすべてのテキストを使い果たすでしょう。つまり、企業は推論システムを含むチャットボットをアップグレードするための新たなソリューションを見つける必要があるということです。

|

スタートアップ企業のDeepSeekは、OpenAIよりも安価な推論モデルでかつてセンセーションを巻き起こした。写真:ブルームバーグ |

昨年以来、OpenAIなどの企業は強化学習技術に注力してきました。このプロセスは通常数か月かかり、その間にAIは試行錯誤を通じて行動を学習します。

例えば、システムは数千の問題を解くことで、正しい答えに到達するための最適な方法を特定できます。そこから研究者たちは、システムが正しい解と間違った解を区別するのに役立つ高度なフィードバック機構を構築します。

「犬の訓練に似ています。システムがうまく機能すればご褒美を与えます。そうでなければ、『あの犬はいたずらっ子だ』と言います」と、OpenAIの研究者であるジェリー・トゥオレク氏は語った。

AIは未来か?

ニューヨーク・タイムズによると、強化学習技術は数学、科学、コンピュータプログラミングといった分野の要件を扱う際に効果的です。これらの分野では、正解と不正解が明確に定義できます。

逆に、強化学習は文章、哲学、倫理学といった善悪の区別が難しい分野では効果がありません。しかしながら、研究者たちは、この手法は数学以外の問題でもAIの性能を向上させることができると主張しています。

「システムは、肯定的な結果と否定的な結果につながる道筋を学習するだろう」とアントロピックの最高科学責任者、ジャレッド・カプラン氏は語った。

|

Claude AIモデルを所有するスタートアップ企業Anthropicのウェブサイト。写真:ブルームバーグ |

強化学習と推論システムは異なる概念であることに注意することが重要です。具体的には、強化学習は推論システムを構築する手法です。これは、チャットボットが推論できるようにするための最終段階のトレーニングです。

チャットボット推論や強化学習はまだ比較的新しいため、科学者たちはAIが人間のように思考するのを助けることができるかどうか確信を持てていません。現在のAIトレーニングのトレンドの多くは、初期には非常に急速に発展し、その後徐々に減速していくことに留意すべきです。

さらに、チャットボットの推論は依然として誤りを犯す可能性があります。システムは確率に基づいて、インターネットから、あるいは強化学習によって学習したデータに最も近いプロセスを選択します。そのため、チャットボットは依然として誤った、あるいは非論理的な解決策を選択する可能性があります。

出典: https://znews.vn/ai-ly-luan-nhu-the-nao-post1541477.html

コメント (0)