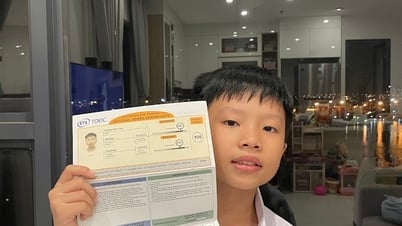

โมเดลใหม่นี้สามารถเข้าถึงได้ผ่าน ChatGPT เวอร์ชันชำระเงิน 20 เหรียญสหรัฐ เป็นแบบมัลติโหมด ซึ่งหมายความว่าโมเดลสามารถรับอินพุตได้ทั้งในรูปแบบข้อความและรูปภาพ (เช่น ภาพหน้าจอของคำถามทดสอบ) จากนั้นโมเดลสามารถวิเคราะห์และตอบคำถามเหล่านี้ในรูปแบบข้อความได้!

OpenAI เปิดตัวโมเดล GPT-4 รุ่นใหม่ ซึ่งสามารถเข้าถึงได้ผ่าน ChatGPT chatbot เวอร์ชันชำระเงิน 20 เหรียญสหรัฐ ภาพ: AFP

OpenAI กล่าวว่าได้ฝังซอฟต์แวร์ใหม่ไว้ในแอปพลิเคชันต่างๆ มากมาย รวมถึงแอปเรียนภาษา Duolingo ซึ่งใช้สร้างหุ่นยนต์สนทนาทางภาษา บริษัท ด้านการศึกษา Khan Academy ที่กำลังออกแบบติวเตอร์ออนไลน์ และ Morgan Stanley Wealth Management ที่กำลังทดสอบแชทบอทภายในองค์กรที่ใช้ GPT-4 เพื่อค้นหาและสรุปข้อมูลสำหรับพนักงาน

ความสามารถในการยอมรับรูปภาพและข้อความเป็นอินพุตให้กับโมเดลหมายความว่าตอนนี้โมเดลสามารถสร้างคำอธิบายโดยละเอียดและตอบคำถามตามเนื้อหาของภาพถ่ายได้

บริษัทดังกล่าวระบุว่าได้ร่วมมือกับ Be My Eyes สตาร์ทอัพสัญชาติเดนมาร์ก ซึ่งเป็นบริษัทที่เชื่อมโยงผู้พิการทางสายตากับอาสาสมัคร เพื่อสร้างอาสาสมัครเสมือนจริงโดยใช้ GPT-4 ซึ่งสามารถให้คำแนะนำหรือช่วยเหลือผู้พิการทางสายตาหรือสายตาเลือนรางได้

GPT-3.5 ซึ่งเป็นรุ่นก่อนหน้าของ GPT-4 ได้รับความสนใจจากผู้คนหลายล้านคนเมื่อช่วงปลายปีที่แล้ว OpenAI เรียก GPT-4 ว่าเป็น “ระบบที่ก้าวหน้าที่สุด” โดยอ้างว่ามีความน่าเชื่อถือมากกว่าและสามารถจัดการกับแบบสอบถามที่ละเอียดอ่อนได้ดีกว่ารุ่นก่อนหน้ามาก

อย่างไรก็ตาม บริษัทได้ตั้งข้อสังเกตถึงปัญหาบางประการว่า “แม้ว่า GPT-4 จะมีประสิทธิภาพ แต่ GPT-4 ก็มีข้อจำกัดเช่นเดียวกับรุ่น GPT ก่อนหน้า นั่นคือไม่น่าเชื่อถืออย่างสมบูรณ์…” บริษัทเสริมว่า “ควรใช้ความระมัดระวังเมื่อใช้เอาต์พุต GPT-4 โดยเฉพาะในบริบทที่ความน่าเชื่อถือเป็นสิ่งสำคัญ”

เมื่อต้นปีนี้ Microsoft ยืนยัน “การลงทุนหลายพันล้านดอลลาร์” ใน OpenAI โดยเดิมพันกับอนาคตของ AI ทั่วไป GPT-4 จะขับเคลื่อนแชทบ็อต Bing ของ Microsoft ซึ่งเปิดตัวในรุ่นเบต้าเมื่อต้นปีนี้ นอกจากนี้ คาดว่า Microsoft จะประกาศการรวมเข้ากับผลิตภัณฑ์สำหรับผู้บริโภคในอีกไม่กี่วันข้างหน้า

ในขณะเดียวกัน Google ได้เปิดแชทบอตสนทนาของตนเองที่ชื่อว่า Bard ให้แก่กลุ่มผู้ทดสอบจำนวนจำกัด และประกาศว่าจะอนุญาตให้ลูกค้าของ Google Cloud เข้าถึง PaLM ซึ่งเป็นโมเดลภาษาขนาดใหญ่ได้เป็นครั้งแรกเพื่อสร้างแอปพลิเคชัน

OpenAI ได้ทำการทดสอบ GPT-4 อย่างเข้มงวดเพื่อทดสอบอันตรายที่อาจเกิดขึ้นจากเทคโนโลยีดังกล่าว และพบว่า GPT-4 มีความเสี่ยงต่อข้อมูลที่ผิดพลาด ความเป็นส่วนตัว และความปลอดภัยทางไซเบอร์ โดยได้เปิดเผยว่า GPT-4 อาจ “สร้างเนื้อหาที่อาจก่อให้เกิดอันตรายได้ เช่น คำแนะนำในการวางแผนโจมตีหรือถ้อยคำแสดงความเกลียดชัง ซึ่งอาจแสดงถึงอคติและมุมมองโลก ที่แตกต่างกัน ...”

OpenAI กล่าวว่าได้ทำงานร่วมกับองค์กรภายนอกเพื่อทดสอบว่า GPT-4 สามารถดำเนินการโดยอัตโนมัติโดยไม่ต้องใช้มนุษย์ได้หรือไม่ และสรุปว่า "อาจจะ" ยังไม่มีความสามารถนี้

มาย อันห์ (เอเอฟพี, เอฟที, ซีเอ็นเอ)

แหล่งที่มา

การแสดงความคิดเห็น (0)