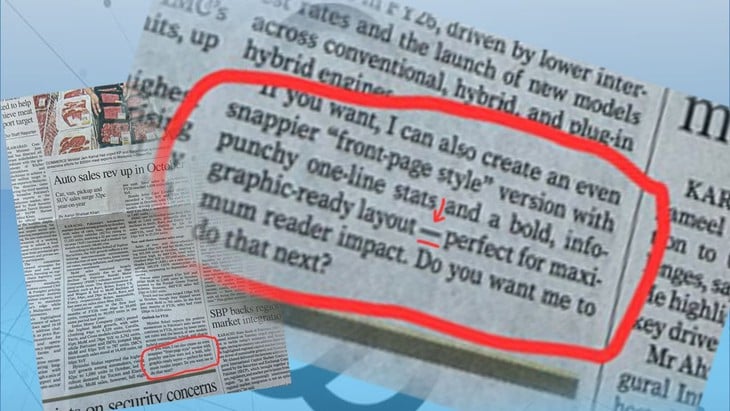

Capture d'écran du compte X montrant un exemple de réponse de ChatGPT tiré d'un article économique du journal pakistanais Dawn - Photo : X

Selon le Straits Times du 13 novembre, Dawn , le principal quotidien anglophone du Pakistan, a dû retirer un paragraphe créé par ChatGPT et présenter des excuses publiques après que des lecteurs l'ont découvert dans un article sur la consommation automobile au Pakistan.

Le problème a été découvert lorsque des lecteurs ont remarqué que la fin de l'article ressemblait trait pour trait à une réponse type obtenue avec ChatGPT, un modèle de langage développé par OpenAI.

« Si vous le souhaitez, je peux aussi créer une version plus attrayante, de type "une", avec des graphiques concis et une mise en page percutante, prête pour une infographie à fort impact. Souhaiteriez-vous que je m'en charge également ? » – Ces détails apparaissent dans l'article.

L’erreur a rapidement été découverte par les lecteurs, et le journal a immédiatement fait face à une vague de critiques concernant l’éthique journalistique, l’intégrité et l’utilisation de l’IA dans le traitement de l’information.

De nombreux internautes n'ont pas tardé à accuser Dawn de manque de transparence et de porter atteinte à la crédibilité de la presse écrite. « C'est une honte pour la presse écrite, et surtout pour un journal comme Dawn , qui jouit d'une excellente réputation », a écrit un utilisateur de Reddit.

Un compte X a exprimé une critique cinglante : « Imaginez donner des leçons d’“éthique des médias” tout en publiant votre propre article généré par une IA. C’est exactement ce que Dawn vient de faire : prise la main dans le sac, elle a utilisé du contenu ChatGPT dans un article imprimé sans même le signaler. Le masque est tombé et l’hypocrisie est dévoilée. »

Le journal a rapidement modifié l'article et présenté des excuses publiques. Dawn a admis que l'article avait été « modifié à l'aide d'une intelligence artificielle, en violation de la politique actuelle de la rédaction en matière d'IA ».

« Le texte original contenait un paragraphe généré par une IA qui a été oublié lors de la révision, et celui-ci a été supprimé de la version en ligne. Une enquête est en cours et l’équipe éditoriale regrette cette erreur », indique le communiqué.

L'IA a été utilisée par de nombreux journalistes et reporters pour vérifier des données ou lire des milliers de pages de documents afin d'en raccourcir le contenu – des tâches qui peuvent prendre des heures, voire des jours, aux journalistes, mais que l'IA peut effectuer en quelques secondes.

Certaines des plus grandes rédactions du monde , dont le New York Times, Bloomberg et Business Insider, utilisent également des outils d'IA dans leurs processus de reportage, mais elles ont établi des normes de modération, notamment une modération humaine obligatoire et une surveillance étroite afin d'éviter les erreurs.

Le journal Dawn aurait également utilisé l'IA pour l'agrégation de nouvelles. Si l'utilisation de l'IA n'est pas en soi répréhensible, « ne pas vérifier le contenu généré par l'IA est excessif », a commenté le journaliste pakistanais Omar Quraishi sur X.

Source : https://tuoitre.vn/de-sot-doan-chatgpt-trong-bai-viet-nhat-bao-hang-dau-pakistan-muoi-mat-xin-loi-20251114093927479.htm

![[Photo] Architecture unique de la station de métro la plus profonde de France](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763107592365_ga-sau-nhat-nuoc-phap-duy-1-6403-jpg.webp)

Comment (0)