עם עלויות התחלתיות של כ-1.3 מיליון דונג וייטנאמי בלבד, כלים מזויפים כמו השתלת פנים וחיקוי קול מעלים אזהרות לגבי הסיכון להונאה, תמונות אישיות מזויפות והשלכות אבטחת סייבר.

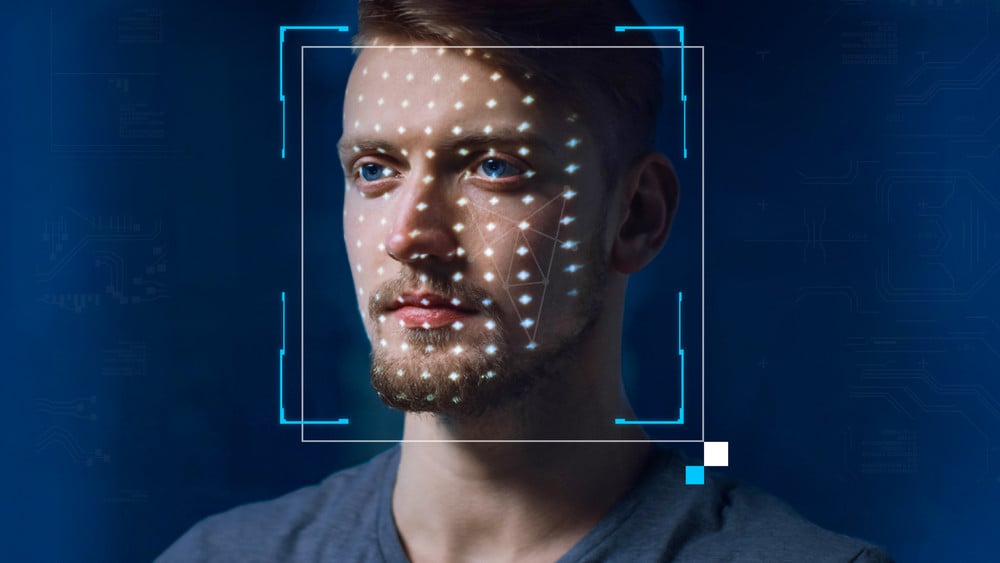

(אִיוּר)

מחירים זולים בדארקנט, סכנה גדולה נסתרת

צוות המחקר והניתוח הגלובלי של קספרסקי (GReAT) פרסם זה עתה ממצאים המראים כי פרסומות רבות המציעות שירותים ליצירת סרטונים ואודיו מזויפים בזמן אמת הופיעו בשווקים האפלים של הרשת. מחירי ההתחלה נרשמו בכ-50 דולר (כ-1.3 מיליון דונג וייטנאמי) וב-30 דולר (כ-800,000 דונג וייטנאמי) להודעות קוליות מזויפות, בהתאם למורכבות ובאורך התוכן.

בעבר, שירותי דיפפייק "לגיטימיים" עלו בין 300 ל-20,000 דולר לדקה.

הירידה החדה במחיר - נמוכה פי 400 מהרמה הפופולרית הקודמת - מגבירה עוד יותר את הסיכון לניצול למעשים רעים.

מאפייני פרסום ו"פיתיון" של אנשים רעים

פרסומות כיום חורגות מעבר לסרטונים מזויפים פשוטים וכוללות החלפת פנים בזמן אמת במהלך שיחות וידאו, זיוף מצלמות מכשירים או "החלפת" פנים כדי לעקוף אימות. הן גם מפרסמות את היכולת לסנכרן הבעות פנים עם קריינות, ואפילו תומכות במספר שפות.

בנוסף, נמכרים גם שירותי "שיבוט קולי", המאפשרים חיקוי קולי עם היכולת להתאים את גובה הצליל והטון כדי לבטא רגשות שונים. עם זאת, מומחים רבים חושדים שמדובר למעשה בפרסומות "לפתות לקוחות" - קונים עלולים להיות מרומים להעביר כסף מראש, אך לא לקבל את המוצר האיכותי כפי שהובטח.

"הצורך להשתמש בכלי הזה גם גובר"

"לא רק ראינו פרסומות המציעות דיפפייק-כשירות, אלא גם שמנו לב לעלייה בביקוש לכלים אלה", אמר דמיטרי גאלוב , ראש צוות GReAT של קספרסקי (רוסיה וחבר העמים).

פושעי סייבר מתנסים ומשלבים בינה מלאכותית באסטרטגיות ההתקפה שלהם, הוא אמר, כאשר חלק מהפלטפורמות אף מפתחות מערכות LLM "זדוניות" משלהן, נפרדות ממודלים ציבוריים ויכולות לפעול ישירות על המכשירים של הרעים.

בעוד ש-Deepfakes עדיין לא יכולים להיחשב כאיום סייבר חדש לחלוטין, הטכנולוגיה עלולה להפוך את ההתקפות למתוחכמות יותר וקשות יותר לגילוי.

המלצות וכיצד לזהות דיפפייק

קספרסקי ממליצה לעסקים ולארגונים לפרוס אמצעי אבטחת סייבר מקיפים, לא רק בהתקנת תוכנת הגנה אלא גם בבניית צוות של מומחי IT בעלי הכישורים לזהות ולתגובה.

בנוסף, יש לאמן את הצוות בארגון לזהות סימנים חריגים בסרטונים או באודיו שעשויים להיות תוצר של טכנולוגיית דיפ-פייק. בסרטונים אלה יש לעתים קרובות תנועות קופצניות ולא טבעיות, תאורה או גווני עור לא עקביים בין פריימים, דמויות המופיעות בתדירות מצמוץ חריגה או כמעט ללא מצמוץ, ופנים שעלולות להיות מעוותות או מעוותות מעט.

בנוסף, איכות התמונה לרוב ירודה והפריימים אינם יציבים, במיוחד בתאורה חלשה, מה שגורם לסרטון הכללי להיראות פחות מציאותי. ערנות לאיומי דיפפייק והעלאת המודעות נתפסים כצעד ראשון חשוב למזעור הנזקים מהונאות מתוחכמות בעידן הבינה המלאכותית.

מקור: https://doanhnghiepvn.vn/chuyen-doi-so/rui-ro-tu-deepfake-gia-re-tu-quang-cao-darknet-den-loi-keu-goi-canh-giac/20251016105304840

תגובה (0)