Apple, Microsoft, Meta, dan Google baru-baru ini merilis model AI baru dengan lebih sedikit "parameter" tetapi tetap memiliki kemampuan yang mumpuni. Langkah ini merupakan upaya dari kelompok teknologi tersebut untuk mendorong bisnis dengan anggaran terbatas agar tetap dapat menggunakan AI.

Foto ilustrasi: FT

Secara umum, semakin tinggi jumlah parameter, semakin baik kinerja perangkat lunak AI dan semakin kompleks serta rumit tugas-tugasnya. Model GPT-40 terbaru dari OpenAI dan Gemini 1.5 Pro dari Google, yang keduanya diumumkan minggu ini, diperkirakan memiliki lebih dari 1 triliun parameter. Sementara itu, Meta sedang melatih versi 400 miliar parameter dari model Llama sumber terbukanya.

Kekhawatiran tentang data dan tanggung jawab hak cipta juga mendorong perusahaan teknologi besar seperti Meta dan Google untuk merilis model bahasa yang lebih kecil dengan hanya beberapa miliar parameter yang lebih murah, lebih hemat energi, dapat disesuaikan, membutuhkan lebih sedikit daya untuk pelatihan dan pengoperasian, dan juga dapat mencegah data sensitif agar tidak disalahgunakan.

“Dengan mencapai kualitas setinggi itu dengan biaya lebih rendah, Anda sebenarnya akan memiliki lebih banyak aplikasi yang dapat diakses pelanggan…,” kata Eric Boyd, wakil presiden Platform AI Azure Microsoft, yang menjual model AI kepada bisnis.

Google, Meta, Microsoft, dan perusahaan rintisan Prancis Mistral juga telah merilis model bahasa yang lebih kecil, tetapi model-model tersebut masih menunjukkan potensi untuk ditingkatkan dan dapat lebih difokuskan pada tugas-tugas spesifik.

Nick Clegg, presiden urusan global di Meta, mengatakan model 8 miliar parameter baru Llama 3 sebanding dengan GPT-4. Microsoft mengatakan model Phi-3 yang lebih kecil, dengan 7 miliar parameter, berkinerja lebih baik daripada GPT-3.5, versi sebelumnya dari model OpenAI.

Model yang lebih kecil juga dapat menangani tugas secara lokal di perangkat alih-alih mengirim informasi ke cloud, yang dapat menarik bagi pelanggan yang sadar akan privasi dan ingin memastikan informasi tetap berada di dalam jaringan internal mereka.

Charlotte Marshall, seorang administrator di firma hukum Addleshaw Goddard, mengatakan bahwa “salah satu tantangan yang menurut saya dihadapi banyak klien kami” ketika mengadopsi produk AI generatif adalah mematuhi persyaratan hukum untuk pemrosesan dan transmisi data. Dia mengatakan model yang lebih kecil menawarkan “kesempatan bagi bisnis untuk mengatasi” masalah hukum dan biaya.

Model yang lebih kecil juga memungkinkan fitur AI berjalan pada perangkat seperti ponsel. Model "Gemini Nano" milik Google tertanam di dalam ponsel Pixel terbaru dan ponsel pintar S24 terbaru dari Samsung.

Apple juga mengungkapkan bahwa mereka sedang mengembangkan model AI untuk dijalankan di iPhone terlarisnya. Bulan lalu, raksasa Silicon Valley ini merilis model OpenELM, sebuah model kecil yang dirancang untuk melakukan tugas-tugas berbasis teks.

Boyd dari Microsoft mengatakan bahwa perangkat yang lebih kecil akan menghasilkan "aplikasi yang menarik, hingga ke ponsel dan laptop."

Direktur OpenAI, Sam Altman, mengatakan pada bulan November bahwa mereka juga menyediakan model AI dengan berbagai skala kepada pelanggan dan "melayani tujuan yang berbeda." Dia berkata, "Ada beberapa hal yang dapat dilakukan dengan sangat baik oleh model yang lebih kecil. Saya sangat antusias tentang hal itu."

Namun, Altman menambahkan bahwa OpenAI akan tetap fokus pada pembangunan model AI yang lebih besar dan terukur yang mampu bernalar, merencanakan, dan mengeksekusi tugas, yang pada akhirnya mencapai kecerdasan setara manusia.

Hoang Hai (menurut FT)

Sumber: https://www.congluan.vn/cac-cong-ty-ai-dang-tim-kiem-loi-nhuan-lon-tu-cac-mo-hinh-ngon-ngu-nho-post296219.html

![[Foto] Upacara Penutupan Sidang ke-10 Majelis Nasional ke-15](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

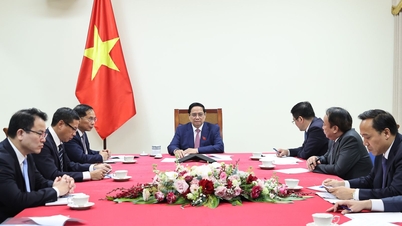

![[Foto] Perdana Menteri Pham Minh Chinh melakukan panggilan telepon dengan CEO Perusahaan Rosatom Rusia.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[RESMI] MISA GROUP MENGUMUMKAN POSISI MEREK PIONIRNYA DALAM MEMBANGUN AI AGENTIK UNTUK BISNIS, RUMAH TANGGA, DAN PEMERINTAH](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

Komentar (0)