A DeepSeak desenvolveu um modelo de IA que não apenas escreve código, mas também verifica e comprova sua própria correção.

O DeepSeekMath-V2 estabeleceu recordes de desempenho sem precedentes, superando as conquistas humanas em rigorosas competições acadêmicas. Notavelmente, o modelo ganhou uma medalha de ouro na Olimpíada Internacional de Matemática (IMO) de 2025 e surpreendeu a todos com uma pontuação de 118/120 no exame Putnam, superando em muito o recorde de 90 maiores pontuações já alcançadas por humanos.

Mas o que realmente torna este modelo inovador não é a pontuação, mas sim o recurso de "autoverificação" do DeepSeek.

Mecanismo de autoverificação e correção de erros do DeepSeek

Durante muitos anos, os modelos de inteligência artificial (IA) e os grandes modelos de linguagem (LLMs) têm enfrentado uma séria fragilidade na resolução de problemas que exigem lógica absoluta, como na matemática, que é o fenômeno de "raciocínio errado, mas resposta correta".

Ou seja, o modelo pode produzir aleatoriamente a resposta final correta, mas a sequência de etapas de inferência, fórmulas ou passos lógicos que levaram a esse resultado pode estar incorreta, incompleta ou ser alucinatória.

Nas áreas de ciência , engenharia e matemática, uma resposta correta com uma solução incorreta não tem absolutamente nenhum valor e reduz significativamente a confiabilidade de um sistema de IA. O DeepSeekMath-V2 foi criado para acabar com essa era de falta de confiabilidade.

A capacidade de autoverificação do DeepSeekMath-V2 é a essência do seu sucesso. Ele atua como um "auditor interno" no processo de raciocínio da IA. Em vez de apenas fazer uma inferência e apresentar uma resposta, o modelo DeepSeekMath-V2 incorpora um mecanismo bidirecional.

A primeira função é a de comprovação, na qual o modelo gera uma cadeia inicial de argumentos e soluções. Em seguida, o modelo aciona automaticamente um sistema de verificação interno, que revisa cada etapa lógica da cadeia de argumentos recém-gerada, procurando por erros, inconsistências ou saltos irrazoáveis.

Esse processo é muito semelhante ao funcionamento do sistema de avaliação IMO-ProofBench, no qual uma IA gera um argumento e outra IA o verifica. Ao repetir essa verificação cruzada até que a cadeia de argumentos seja confirmada como absolutamente sólida, o DeepSeekMath-V2 garante não apenas que a resposta esteja correta, mas também que o caminho para chegar a essa resposta seja absolutamente correto e transparente.

Desvendando o futuro da IA confiável

As implicações desse método de inferência autoverificável podem estabelecer um novo padrão de transparência e confiabilidade para aplicações de IA no mundo real.

No futuro, esse modelo poderá ser aplicado em outras áreas importantes, como: a IA não apenas escreve código, mas também verifica e comprova a correção do mesmo, minimizando erros graves.

Além disso, a IA pode verificar automaticamente cadeias complexas de raciocínio ao desenvolver hipóteses ou provar novos teoremas, garantindo assim a racionalidade e a segurança de decisões importantes tomadas pela IA.

A decisão da DeepSeek de disponibilizar publicamente o código-fonte do modelo em plataformas como Hugging Face e GitHub é uma jogada estratégica, permitindo que a comunidade global de pesquisa acesse e desenvolva a partir desse princípio de inferência verificável.

O DeepSeekMath-V2 representa um salto quântico, demonstrando não apenas a capacidade superior da IA para resolver os problemas mais complexos, mas também garantindo que essa capacidade seja construída sobre uma base de confiança e lógica inabalável. Isso comprova que a próxima geração de IA não será apenas mais inteligente, mas também mais honesta e transparente em seu processo de raciocínio.

Fonte: https://tuoitre.vn/deepseek-phat-trien-mo-hinh-co-kha-nang-tu-kiem-chung-cac-suy-luan-trong-toan-hoc-2025113016585069.htm

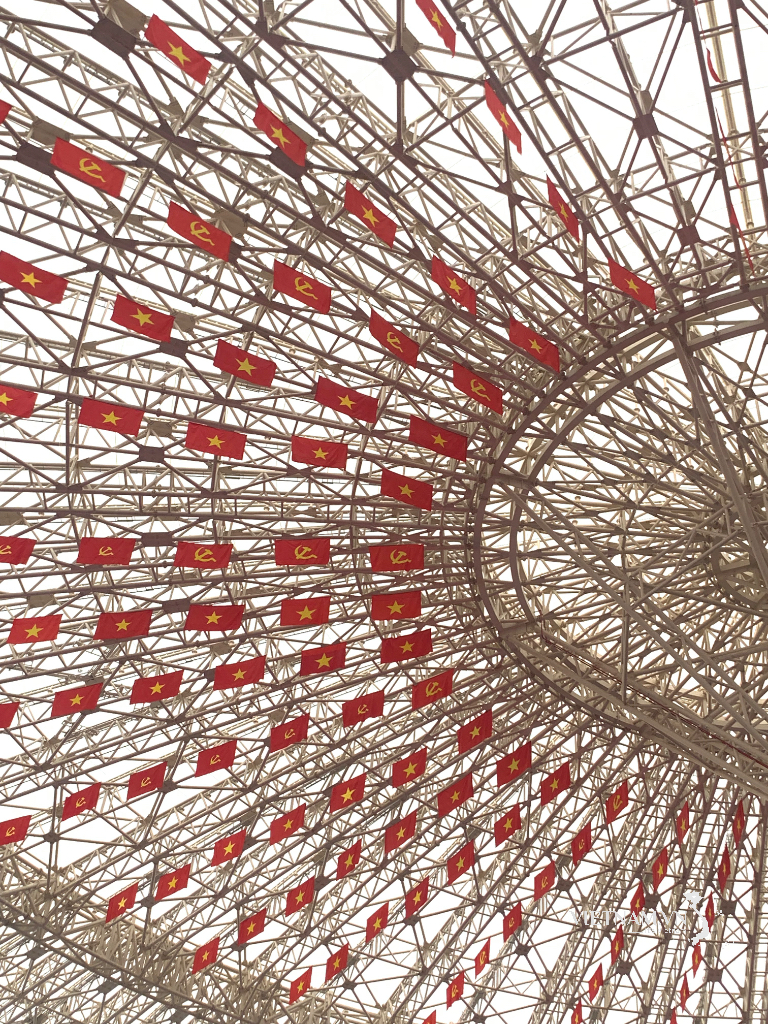

![[Foto] Desfile para celebrar o 50º aniversário do Dia Nacional do Laos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Foto] Adorando a estátua de Tuyet Son - um tesouro de quase 400 anos no Pagode Keo](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

Comentário (0)