Більш складні загрози безпосередньо спрямовані на цілісність та надійність моделей штучного інтелекту.

Відповідно, до 2026 року сфера кібербезпеки стане складнішою, а найбільша загроза виходитиме від «зрілості» кібератак з використанням штучного інтелекту (ШІ).

Атака за допомогою нових технологій від штучного інтелекту

За даними Fortinet, розвиток генеративного штучного інтелекту «демократизував» технології, забезпечивши високу ефективність, але водночас надаючи контроль більшій кількості людей, що збільшує ризики безпеки.

Моделі штучного інтелекту не мають прозорості, а завантаження конфіденційних даних у хмару збільшує потенціал для витоку особистої інформації та інтелектуальної власності.

Зокрема, зловмисники розробляють складні методи використання вразливостей у штучному інтелекті.

Форми атак на моделі включають маніпулювання вхідними даними, щоб обманом змусити ШІ робити хибні прогнози, атаки «отруєння» даних та найнебезпечнішу форму – Prompt Injection – вбудовування прихованих інструкцій, які змушують ШІ обходити правила безпеки або виконувати шкідливі команди.

До 2026 року моделі штучного інтелекту матимуть доступ до більш конфіденційних даних та автоматизованої комунікації між технологічними агентами, що дозволить здійснювати масштабні атаки.

Діпфейк та високорівнева психологічна маніпуляція.

Поряд з цим, прогнозується, що Deepfake виведе шахрайство та психологічну маніпуляцію (соціальну інженерію) на новий рівень. Штучний інтелект здатний створювати звуки, зображення та відео , які практично неможливо відрізнити від справжніх.

Deepfake-as-a-Service буде широко використовуватися для здійснення цілеспрямованих атак, таких як компрометація ділової електронної пошти (BEC), фішинг та вимагання, що змусить організації протистояти дезінформації набагато складнішим для контролю способом.

Крім того, спрощення шпигунства за допомогою штучного інтелекту в поєднанні зі зростанням «сервісних» та спонсорованих кіберзлочинних груп продовжуватиме підживлювати атаки, спрямовані на багатомільярдні міжнародні організації.

Нові цілі атаки

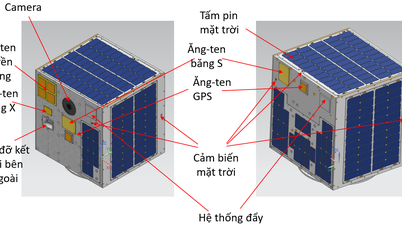

Поряд зі штучним інтелектом, новітні технології також створюють нові цілі для зловмисників. Космічні системи GPS були визначені як головна ціль, де зловмисники можуть глушити, блокувати або підробляти сигнали для підриву критично важливої інфраструктури.

Вибухове зростання супутникового інтернету також пов'язане з ризиками, оскільки незашифровані дані можна легко перехопити за допомогою простих приймачів. Водночас квантові обчислення, хоча й не є безпосередньою загрозою, залишаються серйозним попередженням; квантові комп'ютери можуть зламати майже будь-яке існуюче шифрування, що дозволяє зловмисникам використовувати стратегію «спочатку збирати дані, потім розшифровувати», чекаючи на розвиток технології.

У контексті дедалі небезпечніших кібератак, менеджери з кібербезпеки повинні змінити свої старі методи роботи. Вони повинні бути не просто технічними експертами; вони повинні стати стратегами, перетворюючи безпеку на фактор, який допомагає компанії зростати та ставати більш надійною. Їм потрібно використовувати штучний інтелект для швидкого виявлення та зупинки атак. Що ще важливіше, вони повинні ретельно захищати системи штучного інтелекту компанії.

Джерело: https://tuoitre.vn/nam-2026-the-gioi-se-bi-sieu-tan-cong-mang-chua-tung-co-vi-ai-bi-thao-tung-20251208160719164.htm

![[Зображення] Дослідження військового корабля ВМС США «Роберт Смоллс».](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F10%2F1765341533272_11212121-8303-jpg.webp&w=3840&q=75)

Коментар (0)