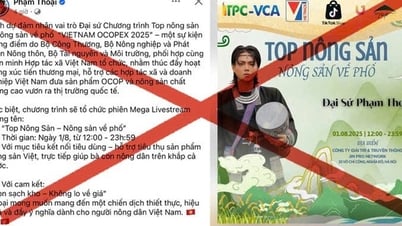

In einer kürzlich in Washington (USA) gehaltenen Rede sagte Smith, seine größte Sorge im Zusammenhang mit KI sei Deepfake, eine Technologie, die realistisch wirkende Bilder und Videos erzeugt. Er forderte Maßnahmen, die es Menschen erleichtern, zwischen echten und gefälschten Fotos und Videos zu unterscheiden.

„Wir müssen uns mit den Problemen rund um Deepfakes auseinandersetzen“, sagte der Microsoft-Präsident. „Wir müssen Maßnahmen ergreifen, um den Einsatz von KI zur Veränderung legitimer Inhalte zu bekämpfen, um Menschen in die Irre zu führen oder zu täuschen.“

Er forderte außerdem die Lizenzierung der wichtigsten Formen der KI mit „Verpflichtungen zum Schutz der Sicherheit, der physischen Sicherheit, der Cybersicherheit und der nationalen Sicherheit“. Wir brauchen neue Exportkontrollen, die zumindest über die bestehenden hinausgehen, um sicherzustellen, dass KI-Modelle nicht gestohlen oder auf eine Weise verwendet werden, die gegen Exportkontrollen verstößt, sagte er.

Die Regulierung von KI ist seit der öffentlichen Einführung des Chatbots ChatGPT von OpenAI ein heißes Thema. Die Gesetzgeber in Washington beschäftigen sich mit der Einführung einer KI-Regulierung, da große und kleine Unternehmen KI schnell auf den Markt bringen wollen.

Letzte Woche erklärte Sam Altman, CEO von OpenAI, vor dem US-Senat, der Einsatz von KI zur Beeinflussung der Wahlintegrität sei ein „großes Problem“. Er argumentierte außerdem, dass KI reguliert werden müsse, und forderte globale Zusammenarbeit in diesem Bereich.

Smith argumentierte, dass Menschen für alle durch KI verursachten Probleme zur Verantwortung gezogen werden müssten. Er forderte die Gesetzgeber auf, KI-Technologien zur Steuerung von Stromnetzen, Wasserversorgungen und anderer kritischer Infrastrukturen zu bremsen, damit Menschen die Kontrolle übernehmen können. Er erwähnte außerdem ein „Know Your Customer“-ähnliches System (KYC), mit dem Entwickler leistungsstarker KI-Modelle erfahren, wie ihre Technologie eingesetzt wird, und die Öffentlichkeit darüber informieren können, welche KI-generierten Inhalte zur Identifizierung gefälschter Videos verwendet werden.

Anfang dieser Woche verbreitete sich ein KI-Bild einer Explosion in der Nähe des Pentagons in den sozialen Medien und wurde von vielen Accounts mit blauen Häkchen geteilt. Die Quelle des Bildes ist unklar, und obwohl das US- Verteidigungsministerium die Fälschung bestätigte, führte es innerhalb weniger Minuten zu einem deutlichen Kursrückgang an den Aktienmärkten.

OSINTdefender , ein Twitter-Account mit blauen Häkchen und über 336.000 Followern, war eine der Seiten, die das Foto teilten. Der Account-Inhaber entschuldigte sich später für die Verbreitung falscher Informationen und sagte, dies sei ein Beispiel dafür, wie „Bilder wie dieses verwendet werden können, um Informationen leicht zu manipulieren“.

Es ist zudem eines von mehreren beliebten KI-Bildern der letzten Wochen, darunter der Papst in einem eleganten weißen Mantel, das Schwarzweißfoto, das den Sony World Photography Award gewann, und die Verhaftung des ehemaligen Präsidenten Donald Trump durch die Polizei.

(Laut CNN, The Guardian)

[Anzeige_2]

Quelle

Kommentar (0)