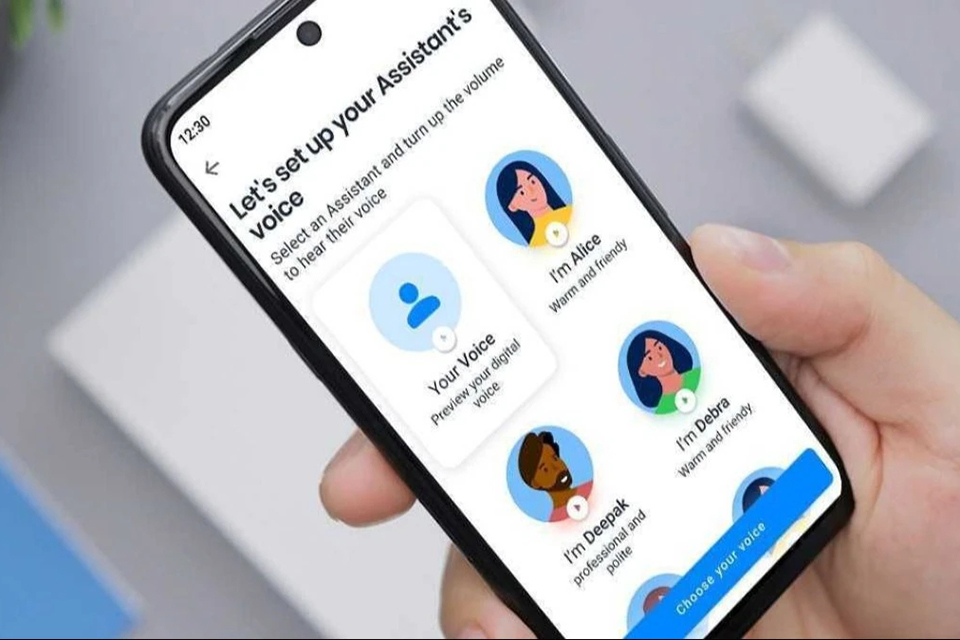

Im September 2022 führte Truecaller für seine zahlenden Nutzer eine KI-gestützte Assistentenfunktion ein. Diese bietet einen Assistenten, der Anrufe entgegennimmt und Fragen mit künstlicher Stimme stellt. Die App ermöglicht es Nutzern, den Assistenten anhand von sieben voreingestellten Stimmen zu konfigurieren.

Der verbesserte KI-Assistent von Truecaller ist zwar nützlich, wirft aber auch gewisse Bedenken auf.

Der KI-Assistent von Truecaller wurde verbessert und kann nun eine künstliche Version der eigenen Stimme erstellen. Diese Funktion ist das Ergebnis einer Zusammenarbeit zwischen Truecaller und Microsoft. Truecaller nutzt die Personal Voice-Technologie von Azure AI Speech, um Nutzern die Möglichkeit zu geben, eine solche künstliche Version ihrer Stimme zu erstellen. So nimmt der KI-Assistent von Truecaller Anrufe entgegen und stellt Fragen an den Gesprächspartner mit dessen Stimme.

Der KI-Assistent von Truecaller ist auf den kostenpflichtigen Tarif beschränkt und nur in wenigen Ländern verfügbar, darunter die USA, Kanada, Australien, Südafrika, Indien, die Schweiz und Chile. Um eine künstliche Stimme von sich selbst zu erstellen, müssen Nutzer den KI-Assistenten über die App aktivieren und den Nutzungsbedingungen zustimmen. Anschließend werden sie aufgefordert, eine Einwilligungserklärung aufzunehmen und einen kurzen Text vorzulesen, der zur Erstellung der künstlichen Stimme verwendet wird.

Hier kommt das Potenzial der Microsoft-Technologie zum Tragen: Aus nur wenigen Sekunden Audiomaterial wird eine künstliche Version der Stimme des Nutzers erstellt. Anschließend nimmt der KI-Assistent eingehende Anrufe entgegen und interagiert mit dem Anrufer, ohne den Besitzer zu stören. Möchte der Anrufer mit dem tatsächlichen Besitzer sprechen, benachrichtigt Truecaller den Nutzer, damit dieser entscheiden kann, ob er den Anruf annimmt oder nicht.

Es ist eine wirklich coole Funktion, die das Potenzial künstlicher Intelligenz in unserem Alltag verdeutlicht, aber sie wirft auch Bedenken hinsichtlich des Missbrauchspotenzials der Stimmklontechnologie auf, da Betrüger KI zunehmend nutzen, um die Stimmen von ihnen bekannten Personen nachzuahmen und Menschen dazu zu bringen, ihnen Geld zu zahlen.

Quelle: https://thanhnien.vn/truecaller-cho-phep-dung-ai-nhan-ban-giong-noi-de-tra-loi-cuoc-goi-185240523230223784.htm

![[Foto] Cat Ba – Grünes Inselparadies](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

Kommentar (0)