Eine Gruppe prominenter internationaler Experten traf sich letzte Woche in Peking, wo sie „rote Linien“ in der KI-Entwicklung identifizierten, darunter die Entwicklung von Biowaffen und die Durchführung von Cyberangriffen.

In einer Erklärung wenige Tage nach dem Treffen warnten die Wissenschaftler, dass ein gemeinsamer Ansatz für die Sicherheit von KI erforderlich sei, um „katastrophale oder gar existenzielle Risiken für die Menschheit in unserer Lebenszeit“ zu verhindern.

„Auf dem Höhepunkt des Kalten Krieges trug die internationale Zusammenarbeit von Regierungen und Wissenschaftlern dazu bei, eine nukleare Katastrophe zu verhindern. Die Menschheit muss erneut zusammenarbeiten, um die Katastrophe zu verhindern, die durch beispiellose Technologien entstehen könnte“, heißt es in der Erklärung.

Experten des Internationalen Dialogs zur KI-Sicherheit in Peking haben „rote Linien“ in der KI-Entwicklung identifiziert. Foto: FT

Zu den Unterzeichnern gehören Geoffrey Hinton und Yoshua Bengio, die oft als die „Väter“ der KI bezeichnet werden; Stuart Russell, ein Professor für Informatik an der University of California; und Andrew Yao, einer der prominentesten Informatiker Chinas.

Die Erklärung erfolgt im Anschluss an den Internationalen Dialog zur Sicherheit von KI, der letzte Woche in Peking stattfand. An diesem Treffen nahmen auch Vertreter der chinesischen Regierung teil, um ihre Zustimmung zu dem Forum und seinen Ergebnissen zum Ausdruck zu bringen.

US-Präsident Joe Biden und der chinesische Präsident Xi Jinping trafen sich im November letzten Jahres und erörterten die Sicherheit von KI. Sie vereinbarten, einen Dialog zu diesem Thema aufzunehmen. Führende globale KI-Unternehmen haben sich in den letzten Monaten ebenfalls zu vertraulichen Gesprächen mit chinesischen KI-Experten getroffen.

Im November 2023 vereinbarten 28 Länder, darunter China, und führende KI-Unternehmen auf dem KI-Sicherheitsgipfel des britischen Schatzkanzlers Rishi Sunak eine umfassende Verpflichtung zur Zusammenarbeit bei der Bewältigung existenzieller Risiken, die von fortschrittlicher KI ausgehen.

In Peking diskutierten Experten vergangene Woche über die Bedrohungen, die mit der Entwicklung von „Künstlicher Allgemeiner Intelligenz – AGI“ oder KI-Systemen verbunden sind, die dem Menschen ebenbürtig oder überlegen sind.

„Im Mittelpunkt der Diskussion standen die roten Linien, die kein leistungsstarkes KI-System überschreiten sollte und die Regierungen weltweit bei der Entwicklung und dem Einsatz von KI festlegen sollten“, sagte Bengio.

Diese roten Linien würden sicherstellen, dass „kein KI-System sich ohne ausdrückliche Zustimmung und Unterstützung des Menschen selbst replizieren oder verbessern kann“ oder „Maßnahmen ergreift, die seine Macht und seinen Einfluss unangemessen erhöhen“.

Die Wissenschaftler fügten hinzu, dass kein System „die Fähigkeit von Akteuren, Massenvernichtungswaffen zu entwickeln, gegen das Übereinkommen über biologische oder chemische Waffen zu verstoßen, wesentlich verbessern“ oder in der Lage sein würde, „automatisch Cyberangriffe durchzuführen, die zu ernsthaften finanziellen Verlusten oder gleichwertigen Schäden führen“.

Hoang Hai (laut FT)

Quelle

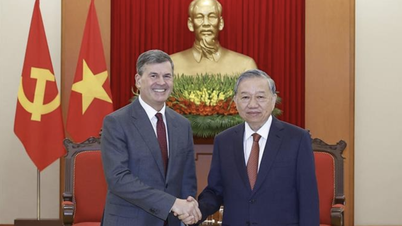

![[Foto] Generalsekretär To Lam empfängt den Direktor der Akademie für öffentliche Verwaltung und Volkswirtschaft beim Präsidenten der Russischen Föderation](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F08%2F1765200203892_a1-bnd-0933-4198-jpg.webp&w=3840&q=75)

Kommentar (0)