Attaquer de tous les côtés.

Google a lancé un nouveau produit d'intelligence artificielle (IA) appelé « Gemini Nano Banana », qui n'est pas une IA linguistique à grande échelle (LLM) capable d'écrire et de raisonner, mais plutôt une IA spécialisée dans la retouche photo... De nombreux utilisateurs sont enthousiasmés par cet outil, mais il présente également un certain nombre d'inconvénients.

« C’est un véritable recul pour l’intelligence artificielle et ses limites éthiques », a déclaré Nguyen Hong Phuc, directeur scientifique de Conductify AI, exprimant ainsi son opinion personnelle. « Gemini Nano Banana possède des capacités de retouche d’image efficaces. Mais la levée de la censure par Google, qui a assoupli les barrières et les mécanismes de limitation, permet à cette IA de créer des images incroyablement ressemblantes à des célébrités, des images suggestives, des images à caractère sensible, etc. », a ajouté M. Phuc.

Selon M. Nguyen Hong Phuc, cette capacité fait du Gemini Nano Banana un outil permettant de créer des images truquées d'un réalisme saisissant, au point que même les experts en IA ne peuvent les distinguer, ce qui engendre de nouveaux risques de fraude et de cybersécurité, comme la création de fausses photos de personnalités politiques célèbres pour diffuser de fausses informations, voire la manipulation de photos et la diffamation de personnes sur les réseaux sociaux par l'IA...

Par ailleurs, avec la prolifération sur Internet de dizaines d'autres outils de retouche photo basés sur l'IA, les arnaques par deepfake ne montrent aucun signe de ralentissement. Les statistiques des organismes de sécurité révèlent que la technologie deepfake est utilisée pour créer des campagnes d'hameçonnage ciblant des personnes influentes, notamment des dirigeants d'entreprise. En 2024, on a dénombré entre 140 000 et 150 000 cas dans le monde, dont 75 % visaient des PDG et des cadres supérieurs. Les deepfakes pourraient accroître les pertes économiques mondiales de 32 %, soit environ 40 milliards de dollars par an d'ici 2027.

Récemment, la société d'intelligence artificielle Anthropic a détecté et déjoué une campagne de cyberattaques menée par des pirates informatiques étrangers. Cette attaque a révélé, pour la première fois, l'utilisation de l'IA pour coordonner des activités d'attaque automatisées. Plus précisément, les pirates ont utilisé des systèmes d'IA pour planifier, diriger et déployer des opérations d'intrusion – une évolution préoccupante qui risque d'accroître l'ampleur et la rapidité des cyberattaques.

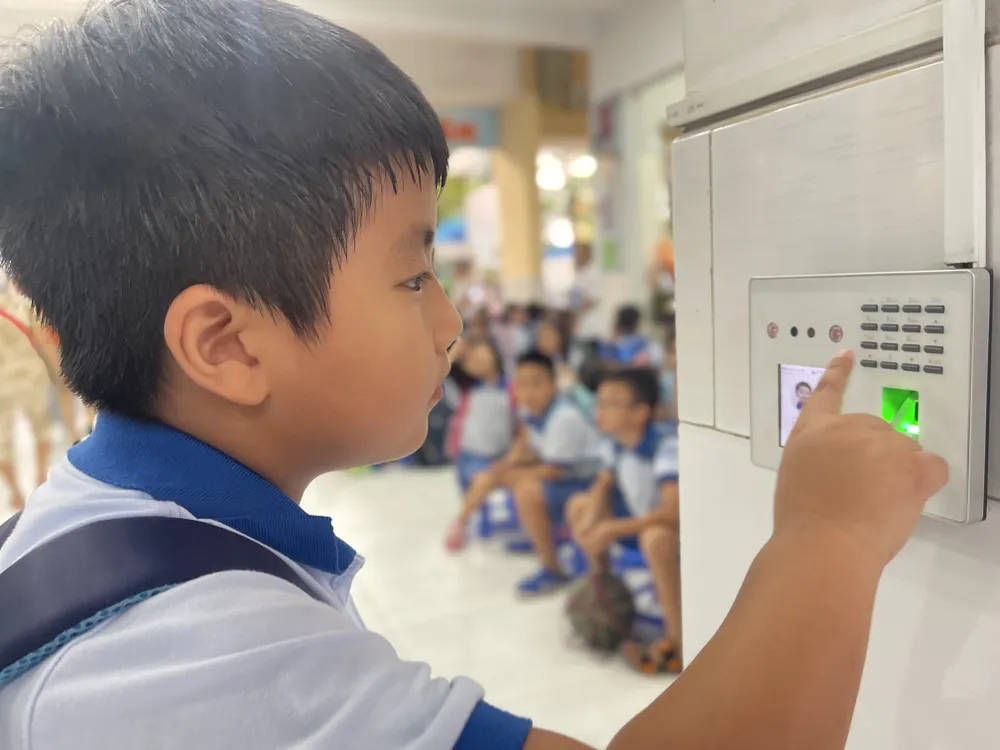

M. Ngo Minh Hieu, directeur de l'organisation antifraude de l'Association nationale de cybersécurité, a indiqué que les outils intégrant l'intelligence artificielle (IA) multiplient par 20 la vitesse de la fraude par rapport à l'intervention humaine. Les fraudeurs fournissent à l'IA un scénario de fraude à analyser, et le système engage automatiquement la conversation avec les victimes. À partir de ces données initiales, l'IA peut comprendre les intentions de la victime et communiquer avec elle en temps réel. La tactique la plus sophistiquée est l'attaque de type « homme du milieu » : lorsqu'un utilisateur effectue une authentification vidéo (par exemple, en enregistrant son visage ou en donnant des instructions), le pirate intervient pour intercepter les données transmises. Les cybercriminels insèrent alors des vidéos deepfake pré-enregistrées, remplaçant le flux de données réel de l'utilisateur afin de contourner le processus d'authentification. Cette méthode expose également les systèmes de sécurité des banques et des institutions financières à des risques de fraude.

Meilleure gestion des données

Avec la généralisation de l'IA, les risques liés à la sécurité et à la confidentialité augmentent considérablement. Les données stockées et traitées sur des serveurs distants deviendront une cible de choix pour les pirates informatiques et les cybercriminels. Selon les données de la National Cyber Security Association, au seul deuxième trimestre 2025, le nombre de cyberattaques utilisant l'IA a augmenté de 62 %, engendrant des pertes mondiales pouvant atteindre 18 milliards de dollars.

Les experts estiment que la protection des données est essentielle. Pourtant, la collecte et la vente de données se poursuivent ouvertement sur de nombreuses plateformes du marché noir, pour des sommes aussi modiques que 20 dollars par mois. Les cybercriminels peuvent utiliser des outils qui imitent les modèles de langage, mais qui sont adaptés à des fins criminelles. Ces outils sont capables de générer des logiciels malveillants et même de contourner les logiciels antivirus.

Au Vietnam, le décret n° 13/2023/ND-CP (en vigueur depuis le 17 avril 2023) encadre la protection des données personnelles. Par ailleurs, la loi sur la protection des données personnelles, dont l'entrée en vigueur est prévue le 1er janvier 2026, renforcera le cadre juridique afin de lutter contre les risques de fuites et d'utilisations abusives de ces données. Cependant, selon l'Association nationale de cybersécurité, l'efficacité de l'application de cette loi doit encore être améliorée sur trois axes : la sensibilisation du public, le renforcement de la responsabilité des entreprises et l'amélioration des capacités de traitement des autorités de régulation. Au-delà des mesures techniques, il est essentiel que chacun développe la capacité d'identifier les signes inhabituels et suspects et de se protéger proactivement contre les interactions numériques dangereuses.

Kaspersky a mis en garde contre l'exploitation de l'IA sombre (un terme désignant le déploiement de grands modèles de langage (MLL) fonctionnant en dehors des contrôles de sécurité standard, permettant souvent des actions telles que le phishing, la manipulation, les cyberattaques ou l'utilisation abusive de données). Les organisations et les particuliers doivent se préparer à faire face à des cyberattaques de plus en plus sophistiquées et difficiles à détecter en raison de la montée en puissance de l'IA sombre dans la région Asie-Pacifique.

Sergey Lozhkin, responsable de l'équipe mondiale de recherche et d'analyse (GReAT) pour le Moyen-Orient, la Turquie, l'Afrique et l'Asie-Pacifique chez Kaspersky, a indiqué que l'une des manifestations actuelles de l'utilisation abusive de l'IA est l'émergence de modèles GPT malveillants. Ces modèles d'IA sont spécifiquement développés ou modifiés pour servir des objectifs contraires à l'éthique et illégaux, tels que la création de logiciels malveillants, la conception de courriels d'hameçonnage sophistiqués et persuasifs pour des attaques de grande envergure, la création de voix et de vidéos truquées (deepfakes), et même le soutien à des attaques simulées.

Les experts de Kaspersky recommandent aux particuliers et aux entreprises d'utiliser des solutions de sécurité de nouvelle génération pour détecter les logiciels malveillants générés par l'IA, tout en accordant la priorité à la protection des données. Les entreprises devraient mettre en œuvre des outils de surveillance en temps réel pour suivre l'exploitation des vulnérabilités liées à l'IA ; renforcer le contrôle d'accès et la formation des employés afin de limiter l'utilisation de l'IA dans les zones non sécurisées et le risque de fuites de données ; et établir un centre d'opérations de cybersécurité pour surveiller les menaces et réagir rapidement aux incidents.

Source : https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

![[Image] Une symphonie brillante et une puissance explosive dans le ciel de Da Nang.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/31/1780196945787_anh-man-hinh-2026-05-31-luc-10-08-51.png)

![[GALERIE] La série de téléphones « brique » élégants qui feront sensation en 2026](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2026/05/31/1780200957638_ba-1-png.webp)

![[Vidéo] Coucher de soleil sur la lagune de Lap An – Là où le soleil se couche sur les filets de pêche](https://vphoto.vietnam.vn/thumb/340x192/vietnam/resource/IMAGE/2026/05/31/1780192137701_beach-landscape-sea-water-nature-grass-745871-pxhere-com.jpeg)

Comment (0)