|

| Illustration d'un appel à considérer l'IA comme une arme biologique. (Source : gizmodo.com) |

Dans l'article « Traiter l'IA comme une arme biologique, et non comme une arme nucléaire », Emilia Javorsky, scientifique -docteure et directrice du Future of Life Institute (États-Unis), soutient que malgré le fait que le monde ait récemment comparé à plusieurs reprises l'IA aux bombes nucléaires, il existe une approche plus appropriée, qui consiste à réglementer ce type de technologie comme une arme biologique ou une biotechnologie.

Selon l'auteur, l'intelligence artificielle est peut-être la technologie la plus puissante de l'histoire de l'humanité, développée aujourd'hui. Ses effets néfastes, tels que la discrimination, les menaces à la démocratie et la concentration des pouvoirs, sont bien documentés.

Pourtant, les entreprises leaders en IA se livrent à une véritable course pour construire des systèmes d'IA toujours plus puissants, faisant grimper les risques à un rythme sans précédent dans l'histoire de l'humanité.

Alors que les dirigeants s'efforcent de contenir et de contrôler l'essor de l'IA et les risques qui y sont associés, ils doivent prendre en compte les mêmes règles et normes que l'humanité a utilisées par le passé pour la créer.

L'adaptation et l'innovation peuvent coexister, surtout lorsque des vies humaines sont en jeu.

Un avertissement de la technologie nucléaire

Bien que l'énergie nucléaire soit plus de 600 fois plus sûre que le pétrole en termes de mortalité et qu'elle soit extrêmement efficace, peu de pays y ont recours en raison des conséquences qu'ils ont constatées de l'approche traditionnelle en matière de nucléaire.

Le monde a découvert la technologie nucléaire avec la bombe atomique et la bombe à hydrogène. Grâce à ces armes, pour la première fois de l'histoire, l'humanité a développé une technologie capable d'anéantir la civilisation humaine, fruit d'une course aux armements qui a privilégié la rapidité et l'innovation au détriment de la sécurité et du contrôle.

Les défaillances ultérieures en matière de sécurité technique et de gestion des risques, tristement célèbres pour avoir provoqué les catastrophes nucléaires de Tchernobyl et de Fukushima, ont anéanti toute chance que le public accepte les aspects positifs de l'énergie nucléaire.

Malgré l’évaluation globalement favorable des risques liés à l’énergie nucléaire et les décennies d’efforts des scientifiques pour convaincre le monde de sa viabilité, le concept même de « nucléaire » reste… entaché.

Lorsqu'une technologie cause des dommages à ses débuts, la prise de conscience sociale et les réactions excessives peuvent en limiter durablement les avantages potentiels. En raison des erreurs initiales commises avec l'énergie nucléaire, l'humanité n'a pas pu tirer profit de cette source d'énergie propre et sûre, et la neutralité carbone et la stabilité énergétique restent un vœu pieux.

La bonne approche en matière de biotechnologie

Pourtant, dans certains domaines, on a vu juste. La biotechnologie en est un exemple : son développement rapide est encouragé face aux nombreux patients qui souffrent et meurent chaque jour de maladies incurables.

L'éthique de cette recherche n'est pas de « foncer tête baissée et de prendre des risques », mais d'innover aussi rapidement et sûrement que possible. L'innovation dans ce domaine est encadrée par un système de réglementations, d'éthique et de normes qui protègent le bien-être de la société et des individus, et préservent le secteur d'une paralysie due à des réactions négatives susceptibles d'entraîner une catastrophe.

Lorsque les armes biologiques furent interdites lors de la Convention sur les armes biologiques pendant la Guerre froide, les superpuissances rivales s'accordèrent sur le fait que la création de telles armes n'était dans l'intérêt de personne. Les dirigeants comprirent que ces technologies, difficiles à contrôler mais très accessibles, ne devaient pas être perçues comme un moyen de gagner la course aux armements, mais comme une menace pour l'humanité elle-même.

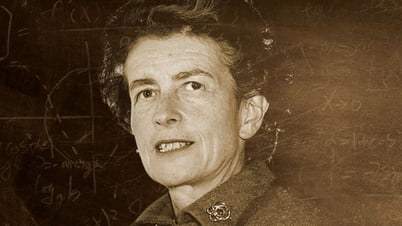

| Emilia Javorsky fait partie des scientifiques qui ont récemment signé une lettre ouverte demandant un moratoire de six mois sur le développement de l'IA. Elle a également signé une déclaration alertant sur le « risque d'extinction » que représente l'IA pour l'humanité. |

La pause dans la course aux armes biologiques permet à l'humanité de les développer à un rythme responsable, les scientifiques et les organismes de réglementation appliquant des normes strictes à toute nouvelle innovation susceptible de nuire potentiellement à l'homme.

Ces adaptations n'ont pas été sans conséquences, mais elles ont également permis la mise en place d'une bioéconomie , avec de nombreuses applications dans des domaines allant des énergies propres à l'agriculture.

Durant la pandémie de Covid-19, les biologistes ont utilisé la technologie de l'ARNm pour produire des vaccins efficaces à une vitesse sans précédent dans l'histoire de l'humanité.

Une récente enquête menée auprès de chercheurs en intelligence artificielle a révélé que 36 % des répondants estimaient que l'IA pourrait provoquer une catastrophe d'ampleur nucléaire. Or, les réactions et réglementations gouvernementales sont lentes, ce qui contraste avec le rythme d'adoption de cette technologie : l'application ChatGPT compte désormais plus de 100 millions d'utilisateurs.

Face à l'escalade rapide des risques liés à l'IA, 1 800 PDG et 1 500 professeurs américains ont récemment signé une lettre demandant un moratoire de six mois sur le développement de l'IA et la mise en place urgente d'une réglementation et de mesures d'atténuation des risques. Ce moratoire permettrait à la communauté internationale de limiter les dommages causés par l'IA et d'éviter un désastre irréversible pour notre société.

Tout en évaluant les risques et les dangers potentiels de l'IA, il est essentiel de ne pas négliger son potentiel positif. Un développement responsable de l'IA nous permettra d'en tirer des bénéfices considérables. Par exemple, son application à la découverte et au développement de médicaments, l'amélioration de la qualité et du coût des soins de santé, ainsi qu'un accès facilité aux médecins et aux traitements médicaux.

DeepMind, filiale de Google, a démontré que l'IA a le potentiel de résoudre des problèmes fondamentaux en biologie que l'humanité a longtemps esquivés. Selon cette étude, l'IA pourrait accélérer la réalisation de tous les Objectifs de développement durable des Nations Unies, orientant ainsi l'humanité vers un avenir où la santé, l'équité, la prospérité et la paix seraient renforcées.

Il est temps que la communauté internationale s'unisse, comme elle l'a fait il y a 50 ans lors de la Convention sur les armes biologiques, afin de garantir un développement sûr et responsable de l'IA. Si nous n'agissons pas rapidement, nous risquons de compromettre l'avenir prometteur de l'IA et de détruire notre société.

Source

![[Photo] Cat Ba - Île paradisiaque verte](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

Comment (0)