Более изощренные угрозы нацелены непосредственно на целостность и надежность моделей искусственного интеллекта.

Таким образом, к 2026 году сфера кибербезопасности станет более сложной, а наибольшую угрозу будет представлять «зрелость» кибератак с использованием искусственного интеллекта (ИИ).

Атака с использованием новых технологий искусственного интеллекта.

По данным компании Fortinet, развитие генеративного искусственного интеллекта «демократизировало» технологии, обеспечив высокую эффективность, но в то же время передав контроль большему числу людей, что увеличивает риски для безопасности.

Модели искусственного интеллекта не отличаются прозрачностью, а загрузка конфиденциальных данных в облако увеличивает вероятность утечки личной информации и интеллектуальной собственности.

В частности, злоумышленники разрабатывают сложные методы для использования уязвимостей в искусственном интеллекте.

К формам атак на модели относятся манипулирование входными данными с целью обмана ИИ и получения ложных прогнозов, атаки с «отравлением» данных, а также наиболее опасная форма — внедрение скрытых инструкций, заставляющих ИИ обходить правила безопасности или выполнять вредоносные команды.

К 2026 году модели искусственного интеллекта получат доступ к более конфиденциальным данным и автоматизированной связи между технологическими агентами, что позволит осуществлять крупномасштабные атаки.

Дипфейки и высокоуровневые психологические манипуляции.

Кроме того, прогнозируется, что технология Deepfake выведет мошенничество и психологические манипуляции (социальную инженерию) на новый уровень. Искусственный интеллект способен создавать звуки, изображения и видео , которые практически невозможно отличить от настоящих.

Сервис Deepfake-as-a-Service будет широко использоваться для проведения целенаправленных атак, таких как компрометация корпоративной электронной почты (BEC), фишинг и вымогательство, что заставит организации бороться с дезинформацией гораздо более сложным для контроля способом.

Кроме того, упрощение шпионажа с помощью ИИ в сочетании с ростом числа «сервисных» и спонсируемых киберпреступных групп будет и дальше подпитывать атаки на многомиллиардные транснациональные организации.

Новые цели атаки

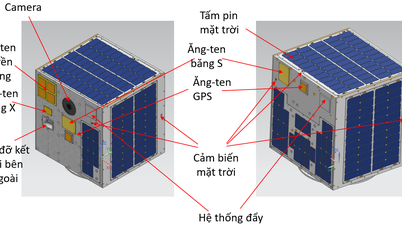

Наряду с искусственным интеллектом, новые технологии также создают новые цели для злоумышленников. Космические системы GPS были определены как основная цель, где злоумышленники могут глушить, блокировать или подделывать сигналы, чтобы подорвать критически важную инфраструктуру.

Взрывной рост спутникового интернета также сопряжен с рисками, поскольку незашифрованные данные могут быть легко перехвачены с помощью простых приемников. В то же время квантовые вычисления, хотя и не представляют непосредственной угрозы, остаются серьезным предупреждением; квантовые компьютеры могут взломать практически любое существующее шифрование, позволяя злоумышленникам использовать стратегию «сначала собрать данные, потом расшифровать», ожидая, пока технология созреет.

В условиях все более опасных кибератак менеджерам по кибербезопасности необходимо изменить свои устаревшие методы работы. Им нужно быть не просто техническими экспертами, а стратегами, превращая безопасность в фактор, способствующий росту компании и повышению ее доверия. Им необходимо использовать ИИ для быстрого обнаружения и предотвращения атак. Что еще важнее, они должны обеспечить надежную защиту систем ИИ компании.

Источник: https://tuoitre.vn/nam-2026-the-gioi-se-bi-sieu-tan-cong-mang-chua-tung-co-vi-ai-bi-thao-tung-20251208160719164.htm

![[Фото] Осмотрите военный корабль ВМС США USS Robert Smalls.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F10%2F1765341533272_11212121-8303-jpg.webp&w=3840&q=75)

Комментарий (0)