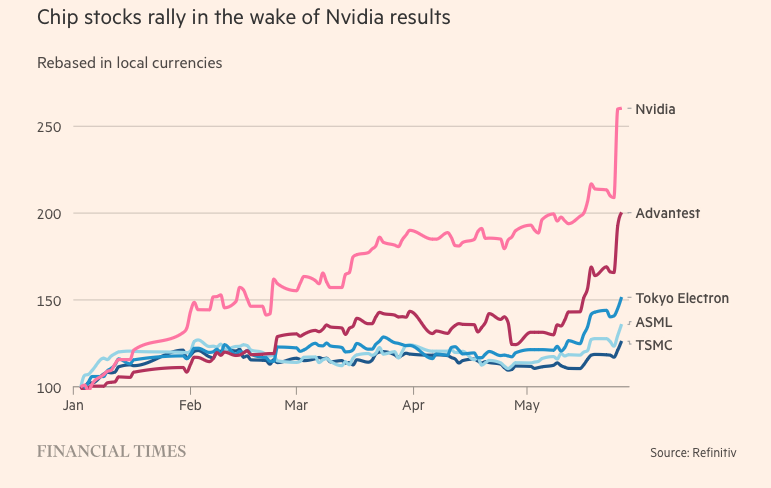

เดิมที Nvidia เป็นที่รู้จักในฐานะผู้ผลิตชิปที่ใช้ในอุตสาหกรรมวิดีโอเกม แต่ในช่วงไม่กี่ปีที่ผ่านมาได้เปลี่ยนมาให้ความสำคัญกับตลาดศูนย์ข้อมูลมากขึ้น

บริษัทผลิตชิปสัญชาติอเมริกันแห่งนี้เติบโตอย่างรวดเร็วในช่วงการระบาดใหญ่ เนื่องจากความต้องการใช้งานเกมและแอปพลิเคชันบนคลาวด์เพิ่มสูงขึ้น ควบคู่ไปกับกระแสการขุดคริปโตเคอร์เรนซี ทั่วโลก เมื่อสิ้นสุดปีงบประมาณในวันที่ 29 มกราคม ธุรกิจชิปสำหรับศูนย์ข้อมูลคิดเป็นสัดส่วนมากกว่า 50% ของรายได้ทั้งหมดของบริษัท

ในขณะเดียวกัน ChatGPT แชทบอทที่ได้รับความนิยมอย่างมาก ได้ยกระดับการสร้างเนื้อหาด้วยปัญญาประดิษฐ์ (AI) ไปอีกขั้นในปีนี้ เทคโนโลยีนี้ใช้ข้อมูลจำนวนมหาศาลที่มีอยู่เพื่อสร้างเนื้อหาใหม่ในหลากหลายหัวข้อ ตั้งแต่บทกวีไปจนถึงการเขียนโปรแกรมคอมพิวเตอร์

ไมโครซอฟต์และอัลฟาเบท สองยักษ์ใหญ่ด้านเทคโนโลยีและผู้เล่นหลักในวงการปัญญาประดิษฐ์ เชื่อว่าเทคโนโลยีการสร้างข้อมูลอัตโนมัติสามารถเปลี่ยนแปลงวิธีการทำงานของผู้คนได้ ทั้งสองบริษัทจึงเริ่มแข่งขันกันเพื่อบูรณาการปัญญาประดิษฐ์เข้ากับเครื่องมือค้นหาและซอฟต์แวร์สำนักงาน โดยมีเป้าหมายที่จะครองอุตสาหกรรมนี้

Goldman Sachs คาดการณ์ว่า การลงทุนในปัญญาประดิษฐ์ (AI) ของสหรัฐฯ อาจมีมูลค่าสูงถึงประมาณ 1% ของผลผลิต ทางเศรษฐกิจ ของประเทศภายในปี 2030

ซูเปอร์คอมพิวเตอร์ที่ใช้ในการประมวลผลข้อมูลและการสร้างปัญญาประดิษฐ์ (AI) อาศัยหน่วยประมวลผลกราฟิก (GPU) GPU ถูกออกแบบมาเพื่อจัดการกับงานคำนวณเฉพาะที่เกี่ยวข้องกับ AI และมีประสิทธิภาพมากกว่าหน่วยประมวลผลกลาง (CPU) จากผู้ผลิตชิปรายอื่น เช่น Intel อย่างมาก ตัวอย่างเช่น ChatGPT ของ OpenAI ใช้ GPU ของ Nvidia หลายพันตัวในการขับเคลื่อน

ขณะเดียวกัน Nvidia ครองส่วนแบ่งตลาด GPU ประมาณ 80% คู่แข่งหลักของ Nvidia ได้แก่ Advanced Micro Devices และชิป AI ภายในจากบริษัทเทคโนโลยีต่างๆ เช่น Amazon, Google และ Meta Platforms

เคล็ดลับสู่การบรรลุธรรมขั้นสูงสุด

ความก้าวหน้าครั้งสำคัญของบริษัทนี้เกิดขึ้นได้จากชิป H100 ซึ่งใช้สถาปัตยกรรม "Hopper" ใหม่ของ Nvidia – ซึ่งตั้งชื่อตามเกรซ ฮอปเปอร์ ไอคอนแห่งวงการเขียนโปรแกรมชาวอเมริกัน กระแสความนิยมด้าน AI ทำให้ H100 กลายเป็นสินค้าที่ได้รับความนิยมมากที่สุดในซิลิคอนแวลลีย์

ชิปขนาดมหึมาเหล่านี้ ซึ่งใช้ในศูนย์ข้อมูล มีทรานซิสเตอร์ถึง 80 พันล้านตัว มากกว่าชิปซิลิคอนที่ใช้ใน iPhone รุ่นล่าสุดถึงห้าเท่า แม้ว่าจะมีราคาแพงกว่ารุ่นก่อนหน้าอย่าง A100 (ที่วางจำหน่ายในปี 2020) ถึงสองเท่า แต่ผู้ใช้ H100 ต่างกล่าวว่าชิปนี้ให้ประสิทธิภาพเพิ่มขึ้นถึงสามเท่า

H100 กำลังได้รับความนิยมอย่างมากจากบริษัทเทคโนโลยีขนาดใหญ่ เช่น Microsoft และ Amazon ซึ่งกำลังสร้างศูนย์ข้อมูลขนาดใหญ่ที่เน้นการประมวลผล AI รวมถึงสตาร์ทอัพ AI รุ่นใหม่ เช่น OpenAI, Anthropic, Stability AI และ Inflection AI เนื่องจากให้ประสิทธิภาพที่สูงกว่า ซึ่งสามารถเร่งการเปิดตัวผลิตภัณฑ์หรือลดต้นทุนการฝึกอบรมในระยะยาวได้

“นี่คือหนึ่งในทรัพยากรทางเทคนิคที่หายากที่สุดในขณะนี้” แบรนนิน แมคบี ประธานเจ้าหน้าที่ฝ่ายกลยุทธ์และผู้ก่อตั้ง CoreWeave สตาร์ทอัพด้านคลาวด์ที่ขับเคลื่อนด้วย AI และเป็นหนึ่งในบริษัทแรกๆ ที่ได้รับชิป H100 เมื่อต้นปีนี้กล่าว

ลูกค้าบางรายโชคไม่ดีเท่า CoreWeave ต้องรอถึงหกเดือนกว่าจะได้รับผลิตภัณฑ์เพื่อนำไปฝึกฝนชุดข้อมูลขนาดใหญ่ สตาร์ทอัพด้าน AI หลายแห่งกังวลว่า Nvidia จะไม่สามารถตอบสนองความต้องการของตลาดได้

อีลอน มัสก์ สั่งซื้อชิป Nvidia หลายพันชิ้นสำหรับสตาร์ทอัพด้าน AI ของเขา โดยกล่าวว่า "ตอนนี้ GPU หายากกว่ายาเสียอีก"

ซีอีโอของเทสลาเปิดเผยว่า “ต้นทุนคอมพิวเตอร์พุ่งสูงขึ้นอย่างมาก จำนวนเงินขั้นต่ำที่จำเป็นสำหรับฮาร์ดแวร์เซิร์ฟเวอร์ที่ใช้ในการสร้าง AI ที่ล้ำสมัยนั้นสูงถึง 250 ล้านดอลลาร์”

แม้ว่า H100 จะออกมาในเวลาที่เหมาะสม แต่ความก้าวหน้าครั้งสำคัญของ Nvidia ในด้าน AI นั้นเกิดขึ้นเมื่อสองทศวรรษก่อนหน้านั้น โดยขับเคลื่อนด้วยนวัตกรรมซอฟต์แวร์มากกว่าฮาร์ดแวร์ ในปี 2549 บริษัทได้เปิดตัวซอฟต์แวร์ CUDA ซึ่งใช้ประโยชน์จาก GPU เพื่อเร่งความเร็วงานต่างๆ นอกเหนือจากงานด้านกราฟิก

“Nvidia มองเห็นอนาคตได้เร็วกว่าบริษัทอื่น ๆ และหันมาพัฒนา GPU ที่ตั้งโปรแกรมได้ บริษัทมองเห็นโอกาส ลงทุนอย่างใหญ่หลวง และทำผลงานได้เหนือกว่าคู่แข่งอย่างต่อเนื่อง” นาธาน เบนาอิค หุ้นส่วนของ Air Street Capital และนักลงทุนในสตาร์ทอัพด้าน AI กล่าว

(อ้างอิงจากรอยเตอร์และไฟแนนเชียลเทจ)

[โฆษณา_2]

แหล่งที่มา

![[อินโฟกราฟิก] กิจกรรมมากมายในงานรำลึกครบรอบ 96 ปีแห่งการเสียชีวิตของรองศาสตราจารย์เหงียน ซิงห์ ซัค](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765441454787_infographic-nhieu-hoat-dong-tai-le-gio-lan-thu-96-cua-cu-pho-bang-nguyen-sinh-sac20251211010322.webp)

การแสดงความคิดเห็น (0)