Apple, Microsoft, Meta та Google нещодавно випустили нові моделі штучного інтелекту з меншою кількістю «параметрів», але все ще потужними можливостями. Цей крок є спробою цих технологічних груп заохотити компанії з обмеженими бюджетами все ще використовувати штучний інтелект.

Ілюстративне фото: FT

Зазвичай, чим більша кількість параметрів, тим краща продуктивність програмного забезпечення штучного інтелекту, а також тим складнішими та нюансованішими стають його завдання. За оцінками, остання модель OpenAI GPT-4o та Google Gemini 1.5 Pro, обидві анонсовані цього тижня, мають понад 1 трильйон параметрів. Тим часом Meta навчає версію своєї моделі Llama з відкритим кодом, яка містить 400 мільярдів параметрів.

Занепокоєння щодо даних та відповідальності за авторські права також спонукали великі технологічні компанії, такі як Meta та Google, випускати менші мовні моделі лише з кількома мільярдами параметрів, які є дешевшими, енергоефективнішими, настроюваними, потребують менше енергії для навчання та роботи, а також можуть запобігти компрометації конфіденційних даних.

«Досягаючи такої високої якості за нижчою ціною, ви фактично матимете більше програм для доступу клієнтів…», — сказав Ерік Бойд, віцепрезидент платформи Azure AI компанії Microsoft, яка продає моделі штучного інтелекту підприємствам.

Google, Meta, Microsoft та французький стартап Mistral також випустили менші мовні моделі, але вони все ще демонструють потенціал для вдосконалення та можуть бути краще зосереджені на конкретних завданнях.

Нік Клегг, президент з глобальних справ Meta, сказав, що нова модель Llama 3 з 8 мільярдами параметрів порівнянна з GPT-4. Microsoft заявила, що її менша модель Phi-3 з 7 мільярдами параметрів працює краще, ніж GPT-3.5, попередня версія моделі OpenAI.

Менші моделі також можуть обробляти завдання локально на пристрої, замість того, щоб надсилати інформацію в хмару, що може зацікавити клієнтів, які дбають про конфіденційність і хочуть забезпечити збереження інформації в їхній внутрішній мережі.

Шарлотта Маршалл, адміністратор юридичної фірми Addleshaw Goddard, каже, що «однією з проблем, з якою, на мою думку, зіткнулися багато наших клієнтів» під час впровадження генеративних продуктів штучного інтелекту, є дотримання законодавчих вимог щодо обробки та передачі даних. Вона каже, що менші моделі пропонують «можливість для бізнесу подолати» юридичні та фінансові проблеми.

Менші моделі також дозволяють запускати функції штучного інтелекту на таких пристроях, як мобільні телефони. Модель Google "Gemini Nano" вбудована в найновіші телефони Pixel та останній смартфон Samsung S24.

Apple також повідомила, що розробляє моделі штучного інтелекту для роботи на своєму бестселері iPhone. Минулого місяця гігант Кремнієвої долини випустив модель OpenELM – невелику модель, призначену для виконання текстових завдань.

Бойд з Microsoft заявив, що менші пристрої призведуть до появи «цікавих додатків, аж до телефонів і ноутбуків».

Директор OpenAI Сем Альтман заявив у листопаді, що вони також надають клієнтам моделі штучного інтелекту різного масштабу, які «служать різним цілям». Він сказав: «Є деякі речі, які менші моделі справлятимуться справді добре. Я дуже цьому радий».

Однак Альтман додав, що OpenAI залишатиметься зосередженим на створенні більших, масштабованих моделей штучного інтелекту, здатних міркувати, планувати та виконувати завдання, зрештою досягаючи інтелекту людського рівня.

Хоанг Хай (за даними FT)

Джерело: https://www.congluan.vn/cac-cong-ty-ai-dang-tim-kiem-loi-nhuan-lon-tu-cac-mo-hinh-ngon-ngu-nho-post296219.html

![[Фото] Церемонія закриття 10-ї сесії 15-ї Національної асамблеї](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

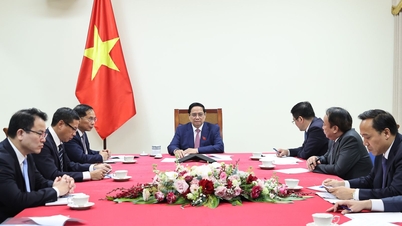

![[Фото] Прем'єр-міністр Фам Мінь Чінь провів телефонну розмову з генеральним директором російської корпорації "Росатом".](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[ОФІЦІЙНО] MISA GROUP ОГОЛОШУЄ ПРО СВОЄ ПЕРШЕ ПОЗИЦІОНУВАННЯ БРЕНДУ В ОБЛАСТІ СТВОРЕННЯ АГЕНТНОГО ШТУЧНОГО ВИКОРИСТАННЯ ДЛЯ БІЗНЕСУ, ДОМОГОСПОДАРСТВА ТА УРЯДУ](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

Коментар (0)