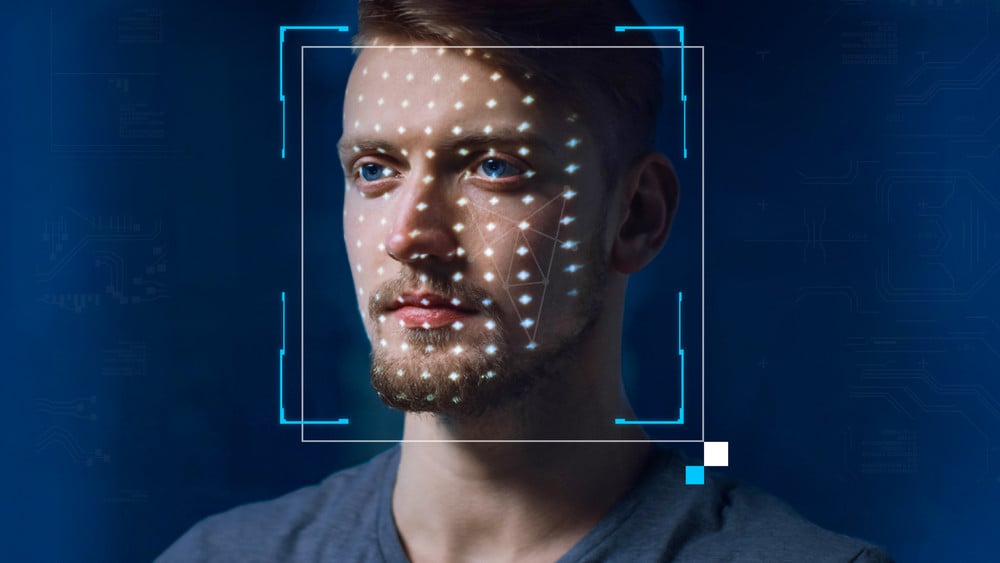

Avec un coût de départ d'environ 1,3 million de VND seulement, les outils frauduleux tels que la greffe de visage et l'imitation vocale suscitent des inquiétudes quant aux risques de fraude, de fausses images personnelles et de conséquences en matière de cybersécurité.

(Illustration)

Des prix bas sur le darknet, un grand danger caché

L'équipe mondiale de recherche et d'analyse de Kaspersky (GReAT) vient de publier des résultats montrant que de nombreuses publicités proposant des services de création de vidéos et d'audio truqués en temps réel sont apparues sur les marchés du darknet. Les prix de départ sont d'environ 50 USD (environ 1,3 million de VND) pour les vidéos et de 30 USD (environ 800 000 VND) pour les messages vocaux truqués, selon la complexité et la durée du contenu.

Auparavant, les services de deepfake « légitimes » coûtaient entre 300 et 20 000 dollars la minute.

La chute brutale du prix – 400 fois inférieur au niveau populaire précédent – accroît encore le risque d’exploitation à des fins malveillantes.

Caractéristiques publicitaires et « appâts » des méchants

Les publicités ne se limitent plus aux simples fausses vidéos : elles proposent désormais l’échange de visages en temps réel lors des appels vidéo, la falsification de l’image de la caméra ou le « remplacement » de visages pour contourner l’authentification. Elles mettent également en avant la synchronisation des expressions faciales avec la voix off et proposent même des publicités multilingues.

De plus, des services de « clonage vocal » sont également proposés, permettant d'imiter la voix et d'en moduler la hauteur et le ton pour exprimer différentes émotions. Cependant, de nombreux experts soupçonnent qu'il s'agit en réalité de publicités trompeuses : les acheteurs pourraient être amenés à verser de l'argent à l'avance sans recevoir le produit de qualité promis.

« Le besoin d’utiliser cet outil est également croissant. »

« Nous avons non seulement vu des publicités proposant des deepfakes en tant que service, mais nous avons également constaté une augmentation de la demande pour ces outils », a déclaré Dmitry Galov , responsable de l'équipe GReAT de Kaspersky (Russie et CEI).

Les cybercriminels expérimentent et intègrent l'IA dans leurs stratégies d'attaque, a-t-il déclaré, certaines plateformes développant même leurs propres LLM « malveillants », distincts des modèles publics et capables de s'exécuter directement sur les appareils des méchants.

Bien que les deepfakes ne puissent pas encore être considérés comme une cybermenace totalement nouvelle, cette technologie pourrait rendre les attaques plus sophistiquées et plus difficiles à détecter.

Recommandations et comment identifier les deepfakes

Kaspersky recommande aux entreprises et aux organisations de déployer des mesures de cybersécurité complètes, en ne se contentant pas d'installer un logiciel de protection, mais en constituant également une équipe d'experts informatiques possédant les compétences nécessaires pour détecter les menaces et y répondre.

De plus, le personnel de l'organisation devrait être formé à reconnaître les signes inhabituels dans les vidéos ou les enregistrements audio pouvant être le résultat de la technologie deepfake. Ces vidéos présentent souvent des mouvements saccadés et non naturels, un éclairage ou des teintes de peau incohérents d'une image à l'autre, des personnages dont les yeux clignent anormalement vite ou presque jamais, et des visages parfois déformés.

De plus, la qualité d'image est souvent médiocre et les images sont instables, surtout en basse lumière, ce qui rend la vidéo globalement moins réaliste. Rester vigilant face aux menaces liées aux deepfakes et sensibiliser le public est considéré comme une première étape essentielle pour minimiser les dégâts causés par les escroqueries sophistiquées à l'ère de l'IA.

Source : https://doanhnghiepvn.vn/chuyen-doi-so/rui-ro-tu-deepfake-gia-re-tu-quang-cao-darknet-den-loi-keu-goi-canh-giac/20251016105304840

![[Photo] Défilé pour célébrer le 50e anniversaire de la fête nationale du Laos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[Photo] Vénération de la statue de Tuyet Son - un trésor vieux de près de 400 ans à la pagode Keo](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[Vidéo] Protéger le patrimoine mondial des changements climatiques extrêmes](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/03/1764721929017_dung00-57-35-42982still012-jpg.webp)

Comment (0)