Dans un article du 23 novembre, Reuters citait deux sources affirmant que la lettre n'avait jamais été mentionnée auparavant et que l'algorithme d'IA constituait un développement significatif avant le licenciement de Sam Altman, cofondateur et PDG d'OpenAI, le 17 novembre. Selon ces sources, la lettre figurait parmi les raisons ayant conduit à la décision de limoger le conseil d'administration d'OpenAI.

Les chercheurs qui ont rédigé et envoyé la lettre n'ont pas immédiatement répondu à notre demande de commentaires.

Altman a opéré un retour triomphal tard dans la soirée du 21 novembre, après que plus de 700 employés d'OpenAI ont menacé de démissionner et de rejoindre Microsoft avec le PDG limogé. Cet événement a mis fin à près d'une semaine de turbulences marquée par une série de rebondissements inattendus chez OpenAI, l'une des entreprises de recherche en intelligence artificielle les plus importantes au monde et propriétaire de l'application populaire ChatGPT.

M. Altman lors d'un événement de l'APEC aux États-Unis le 16 novembre.

Selon l'une des sources, Mira Murati, une cadre supérieure de longue date d'OpenAI, a mentionné un projet appelé Q* (prononcé « Q Star ») aux employés le 22 novembre et a déclaré qu'une lettre avait été envoyée au conseil d'administration de la société avant la vague de choc technologique mondiale du week-end dernier.

Après la publication de cet article, un porte-parole d'OpenAI a déclaré que Mme Murati avait informé son personnel de ce que les médias allaient révéler, mais qu'elle ne commenterait pas l'exactitude des informations.

Sam Altman reprend son poste de PDG d'OpenAI.

Une source a révélé qu'OpenAI a progressé sur le Projet Q*. Certains au sein de l'entreprise estiment que ce projet pourrait constituer une avancée majeure dans la quête d'OpenAI pour la superintelligence, également appelée intelligence artificielle générale (IAG). L'entreprise définit l'IAG comme un système d'IA plus intelligent que l'être humain.

Grâce à ses importantes ressources de calcul, le nouveau modèle peut résoudre certains problèmes, selon la source. Bien que le modèle ne traite que des mathématiques de niveau élémentaire, la source indique que la résolution de tels problèmes rend les chercheurs très optimistes quant au succès futur de Q*.

Les chercheurs considèrent les mathématiques comme un domaine clé du développement de l'IA générative. Actuellement, l'IA générative peut écrire et traduire entre différentes langues, même si les réponses à une même question peuvent varier considérablement. La maîtrise des mathématiques – où il n'existe qu'une seule bonne réponse – permettrait à l'IA de raisonner plus efficacement, à l'instar de l'intelligence humaine. Les chercheurs en IA estiment que cela pourrait ouvrir la voie à de nouvelles recherches scientifiques .

Contrairement à un ordinateur, incapable de résoudre un nombre limité de calculs, l'intelligence artificielle générale (IAG) peut généraliser, apprendre et comprendre les problèmes. Dans une lettre adressée au conseil d'administration d'OpenAI, les chercheurs ont souligné la puissance et les dangers potentiels de l'IA, selon certaines sources. Les informaticiens débattent depuis longtemps des risques posés par les machines superintelligentes, notamment celui de savoir si elles pourraient décider d'anéantir l'humanité à leur profit.

Dans ce contexte, M. Altman a mené des efforts pour faire de ChatGPT l'une des applications logicielles à la croissance la plus rapide de l'histoire et attirer les investissements — ainsi que les ressources informatiques — nécessaires de Microsoft pour se rapprocher de la superintelligence généralisée, ou AGI.

Outre l'annonce d'une série de nouveaux outils lors d'un événement ce mois-ci, M. Altman a déclaré la semaine dernière aux dirigeants mondiaux réunis à San Francisco qu'il pensait que l'intelligence artificielle générale était à portée de main.

Le lendemain, le conseil d'administration d'OpenAI a licencié M. Altman.

Lien source

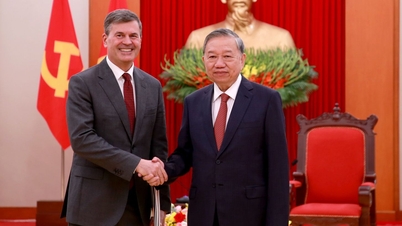

![[Photo] Le secrétaire général To Lam reçoit le directeur de l'Académie d'administration publique et d'économie nationale auprès du président de la Fédération de Russie](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F08%2F1765200203892_a1-bnd-0933-4198-jpg.webp&w=3840&q=75)

Comment (0)