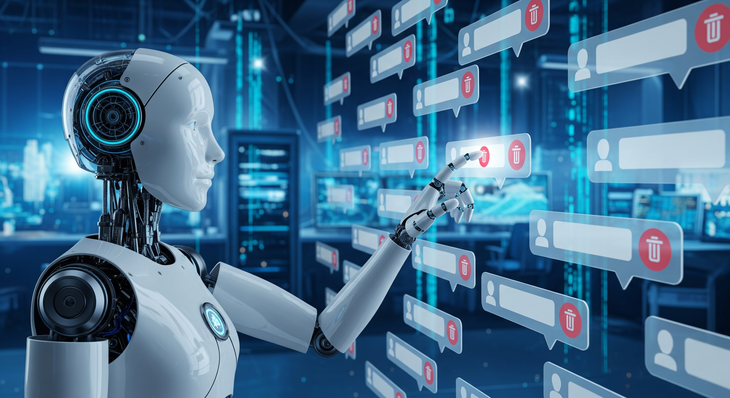

L'IA analyse et supprime les commentaires sur les réseaux sociaux

Lorsqu'une personne laisse un commentaire sur une vidéo YouTube, une publication Facebook ou un article en ligne, elle ignore s'il sera lu. Ce n'est pas à cause d'une faute d'orthographe ou d'un contenu illégal : il est simplement bloqué par un algorithme de filtrage automatique.

Les plateformes numériques utilisent désormais des systèmes de filtrage des commentaires pour supprimer les discours haineux, la pornographie, la violence et les propos incitant à la division. L'objectif est de « garantir la sécurité des communautés », mais ces outils, en aseptisant les contenus, ne risquent-ils pas de devenir insensibles ?

Quand l'IA devient la gardienne de la parole

Contrairement aux débuts d'Internet, où les commentaires bruts pouvaient apparaître librement, la plupart des grandes plateformes délèguent désormais la modération des contenus à l'intelligence artificielle. Grâce à l'apprentissage automatique, ces systèmes analysent chaque jour des millions de lignes de texte, évaluant la langue, le ton et même le contexte pour décider de leur conservation ou de leur suppression.

Cependant, ce système n'est pas toujours précis.

Mme Ngoc Vy (Hô-Chi-Minh-Ville) a témoigné : « Mon commentaire sur un produit a été masqué pour une raison inconnue. Il ne contenait ni insultes ni spam, juste un commentaire qui a disparu au bout de quelques secondes. »

De nombreux contenus sont supprimés simplement parce qu'ils utilisent des mots sensibles dans un contexte tout à fait normal. Des expressions comme « pauvreté », « faim », « politique » ou « système » sont parfois interprétées à tort comme négatives si le système ne parvient pas à saisir le sens de la phrase.

Filtrer ou éliminer les critiques ?

Selon un avertissement de l'organisation allemande AlgorithmWatch, les systèmes de censure automatisés peuvent éliminer involontairement les voix dissidentes, en particulier celles des groupes défavorisés ou minoritaires, car ces systèmes apprennent du comportement de la majorité, qui n'est pas suffisamment diversifiée en termes de culture et de points de vue.

Au Vietnam, le contrôle strict des contenus par les plateformes de médias sociaux se généralise, notamment sur les sites d'information très interactifs. Les commentaires sur l'actualité et les questions sociales sont souvent censurés ou doivent être « préalablement approuvés », ce qui amène beaucoup à se demander : la liberté d'expression existe-t-elle encore dans le cyberespace ?

Ce qui est inquiétant, c'est que les utilisateurs savent rarement pourquoi leurs commentaires sont masqués ou supprimés. Il n'y a ni notifications, ni mécanismes de retour d'information transparents. Tout se fait en catimini, et dans un monde régi par des algorithmes, le silence peut être la forme de censure la plus insidieuse.

Préservons la propreté d'Internet, mais n'édulcorons pas la conversation.

Un cyberespace propre ne doit pas être synonyme de cyberespace stérile. La société est un lieu d'expression d'opinions diverses, constructives et critiques, où s'affrontent et débattent. Si les algorithmes sont nécessaires pour filtrer les discours haineux, il est tout aussi essentiel de protéger le droit à la divergence d'opinions, le droit de questionner et le droit de signaler les problèmes.

Quand chaque commentaire doit être « modéré », il faut se demander : la technologie protège-t-elle la communauté ou filtre-t-elle ce que la communauté est autorisée à entendre ?

La technologie ne peut remplacer l'humain dans la prise de décisions importantes. Et à l'ère de l'IA, la transparence et le droit au retour d'information constituent les « algorithmes » les plus équitables pour l'ensemble du système.

La technologie devrait aider les gens à s'exprimer, et non décider de ce qu'ils disent.

Source : https://tuoitre.vn/khi-ai-quyet-dinh-ban-duoc-noi-gi-tren-mang-20250701231035288.htm

![[Photo] Paysage enchanteur d'une forêt d'érables à Quang Tri](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F10%2F1765353233198_lan09046-jpg.webp&w=3840&q=75)

![[Photo] Explorez le navire de guerre USS Robert Smalls de l'US Navy](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F10%2F1765341533272_11212121-8303-jpg.webp&w=3840&q=75)

![[Vidéo] L'artisanat de la peinture populaire Dong Ho a été inscrit par l'UNESCO sur la Liste des savoir-faire nécessitant une sauvegarde urgente.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/10/1765350246533_tranh-dong-ho-734-jpg.webp)

Comment (0)