Japans statsminister Fumio Kishida sa at han vil legge frem en plan for G7-gruppen for å regulere utviklere av kunstig intelligens (KI).

Formålet med disse reglene er å forhindre spredning av feilinformasjon ved å øke offentlighetens bevissthet om å skille mellom bilder og informasjon produsert av AI og informasjon som ikke er generert av algoritmer.

De foreslåtte retningslinjene forventes å bli lagt frem allerede i høst, på et virtuelt møte mellom verdens syv største økonomier (G7).

Rapporten slo fast at Japan er bekymret for de komplekse bildene og informasjonen som genereres av AI, som kan villede offentligheten og true økonomisk stabilitet.

I mellomtiden har den britiske datatilsynet uttalt at AI-chatboter kan utgjøre personvernrisikoer for barn, i dette tilfellet chatboten «My AI» utviklet av det amerikanske teknologiselskapet Snapchat.

Myndighetene sier at Snapchat kan ha undervurdert personvernrisikoen for barn som AI-chatboten som ble lansert i april i fjor utgjør. Information Commissioner's Office (ICO) uttalte at hvis det amerikanske selskapet ikke kan imøtekomme regulatorenes bekymringer på en tilstrekkelig måte, vil de vurdere å forby AI-appen landsdekkende.

«De første funnene fra etterforskningen tyder på at Snap ikke vurderte personvernrisikoene for barn og andre brukere tilstrekkelig og nøyaktig før lanseringen av AI-appen», sa en representant for ICO.

Uttalelsen fra tilsynsorganet betyr imidlertid ikke at Snapchat, meldingsappen som er mye brukt av unge i Storbritannia, har brutt personvernlovgivningen.

Snap sa at de gjennomgår ICOs kunngjøring og er forpliktet til å beskytte brukernes personvern. «Vår AI har gjennomgått en grundig personvern- og juridisk gjennomgangsprosess før den ble offentliggjort», sa det amerikanske teknologiselskapet. «Vi vil fortsette å jobbe konstruktivt med ICO for å ta opp bekymringer om våre risikovurderingsprosesser.»

ICO etterforsker hvordan «My AI» håndterte personopplysningene til omtrent 21 millioner Snapchat-brukere i Storbritannia, inkludert barn i alderen 13–17 år.

Appen, utviklet av Snapchat, drives av OpenAIs ChatGPT – det mest kjente eksemplet på generativ AI som beslutningstakere over hele verden prøver å håndtere midt i bekymringer om personvern og sikkerhet.

Sosiale medier, inkludert Snapchat, krever at brukerne er 13 år eller eldre, men de lykkes ikke alltid med å forhindre at mindreårige barn bruker plattformene deres.

Tidligere, i august 2023, rapporterte Reuters at regulatorer samlet inn informasjon for å avgjøre om meldingsappen effektivt fjernet mindreårige brukere fra plattformen sin.

(Ifølge Bloomberg og Reuters)

Meta bruker brukerdata fra Facebook og Instagram til å trene sin AI-chatbot.

Meta sier at de bruker brukernes offentlig delte Facebook- og Instagram-innlegg for å trene sin nye virtuelle assistent for kunstig intelligens (KI), men ekskluderer innhold som kun deles med familie og venner.

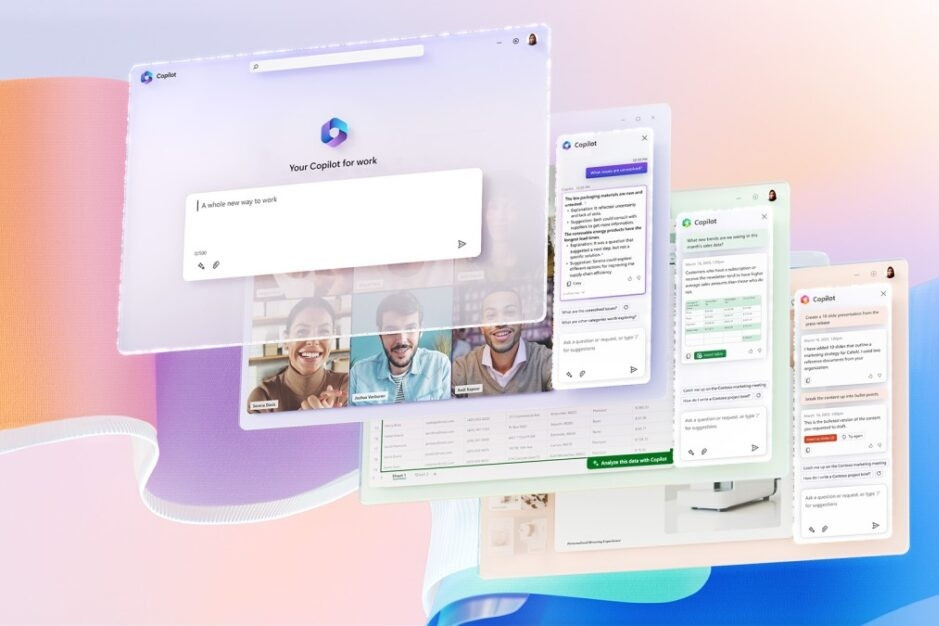

Microsoft lanserer den virtuelle assistenten Copilot for AI-chatboten.

Microsoft Copilot vil være tilgjengelig på Windows 11, Microsoft 365, Edge-nettleseren og Bing-søkemotoren.

Tre nye funksjoner kommer til Googles AI-chatbot, Bard.

Noen av de nye funksjonene som kommer til Google Bard er å bekrefte nøyaktigheten av svar, importere brukerdata på tvers av apper og invitere andre til å chatte med chatboter.

[annonse_2]

Kilde

![[Foto] Avslutningsseremoni for den 10. sesjonen i den 15. nasjonalforsamlingen](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

![[OFFISIELT] MISA GROUP KUNNGJØR SIN PIONERENDE MERKEPOSISJONERING INNEN BYGGINGSAGENT-KI FOR BEDRIFTER, HUSHOLDNINGER OG MYNDIGHETEN](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

Kommentar (0)