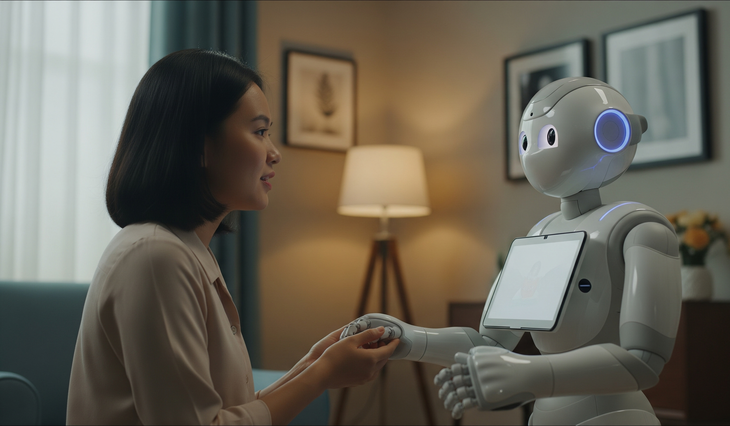

この画像は、心理療法ロボットに心の内を打ち明けている人物を描いている。

かつて心理療法は、注意深く共感的に耳を傾けることを必要とする旅のようなものだった。しかし、人工知能と自然言語処理技術の発展に伴い、新世代の治療用ロボットが登場しつつある。

オフィスに行く必要も、本物の医者に診てもらう必要もなく、電話やタブレットさえあればロボットとの「会話」を始めることができる。しかし、これは多くの人にとって疑問も投げかける。機械からの応答は、本当に人の気分を落ち着かせるのに効果的なのだろうか?

心理療法ロボットはますます高度化している。

GPT、Claude、Geminiといった大規模言語モデル(LLM)の台頭により、セラピーロボットは自然なコミュニケーションが可能になり、一貫性のある共感的な応答を提供できるようになりました。Wysa、Woebot、Replikaなどのスタートアップ企業は、テキストを通して感情を認識し、ユーザーの気分に合わせて応答を調整できるAI搭載チャットアプリケーションを開発しています。

一見単純に見えるこれらの会話の背後には、機械学習と感情分析を組み合わせた複雑な言語処理システムが存在します。AIモデルは、数百万件の匿名会話と行動心理学の理論的枠組みを用いて訓練されています。

ユーザーが「疲れていて、希望が持てない」といったメッセージを送ると、システムは慰めの言葉で応答するだけでなく、精神的な苦痛の兆候を認識し、認知的な調整方法を提案することもできる。

テキスト処理に加え、一部のシステムではAIを統合して音声分析を行い、話す速度、イントネーション、沈黙の頻度などからストレスレベルを認識する。これにより、ユーザーが話していない時でも、ロボットは微妙な感情の変化を「検出」することができる。

応答もますます自然になりつつあり、以前のチャットボットのように定型的なものではなくなってきている。これは、過去のやり取りから継続的に学習するモデルのおかげである。

クラウドコンピューティング技術はすべてのデータを同期させ、スマートフォンでもパソコンでもシームレスなチャット体験を実現します。AIはユーザーの発言だけに頼るのではなく、チャット履歴、やり取りの時間、感情を表すキーワードの頻度などから学習し、一人ひとりに合わせた応答スタイルを構築します。そのため、多くの人がセラピーロボットが時間をかけて本当に「自分を理解してくれる」と感じているのです。

機械が聞くことができるからといって、必ずしも理解できるとは限らない。

Tuoi Tre Onlineの調査によると、AIがどれほど言語を分析できるようになったとしても、意味を理解することと感情を感じることの間には依然として隔たりが存在する。ロボットは定型的な励ましの言葉で応答するかもしれないが、人間の思いやりから生まれる温かさは欠けている。

深刻な精神疾患の危機においては、特に具体的な行動、介入、または緊急支援が必要な場合、ロボットは迅速な対応に取って代わることはまだできない。

さらに、AIシステムは依然として提供されるデータに依存している。訓練データセットに文化、現地語、表現のニュアンスといった多様性が欠けている場合、ロボットの応答は特定の状況において「冷たい」印象を与えたり、不正確に感じられたりする可能性がある。

また、一部のアプリでは、ユーザーが感情を間接的に表現したり、比喩を用いたりする場合に制限がある。こうした表現方法は、心理学的な会話では非常によく用いられる。

さらに、今日のデジタル時代において、プライバシーに関する懸念は無視できません。心理データは機密情報であるため、適切に暗号化および管理されない場合、漏洩の深刻なリスクが生じる可能性があります。テクノロジーがますますパーソナライズされるにつれ、機械システムと感情を共有する際には、関連するリスクを理解する必要があります。

確かに、テクノロジーの発展により、メンタルヘルスケアはかつてないほど身近なものになった。AIやセラピーロボットは、最初の段階で寄り添い、つらい感情から一時的に解放してくれる存在となり得る。しかし、機械に完全に信頼を置くには、依然として慎重さが必要だ。

技術の限界を理解することで、ユーザーは依存することなくその利点を活用する方法を知ることができ、巧妙なコードに操られるのではなく、自分の感情をコントロールし続けることができるようになる。

出典:https://tuoitre.vn/robot-tri-lieu-tam-ly-co-thau-hieu-hay-chi-biet-lang-nghe-20250618102426124.htm

コメント (0)