La table ronde « L’IA au service de l’humanité : éthique et sécurité de l’IA à l’ère nouvelle », organisée dans le cadre de la Semaine de la science et de la technologie VinFuture 2025, réunit des scientifiques, des politiciens et des inventeurs pour discuter d’un développement responsable de l’IA, orienté vers des valeurs humanistes.

En marge de la discussion, le professeur Toby Walsh de l'Université de Nouvelle-Galles du Sud (Australie), membre de l'American Association for Computing Machinery, a partagé son point de vue sur l'utilisation éthique et responsable de l'IA.

L’utilisation responsable de l’IA devrait être obligatoire

Selon le professeur, l'utilisation responsable de l'IA devrait-elle être volontaire ou obligatoire ? Et comment devrions-nous concrètement nous comporter face à l'IA ?

Professeur Toby Walsh : Je suis fermement convaincu que l’utilisation responsable de l’IA devrait être obligatoire. Les sommes colossales générées par l’IA engendrent actuellement des incitations perverses, et seul un cadre réglementaire strict permettra de garantir des pratiques responsables, afin que l’intérêt public soit toujours en équilibre avec les intérêts commerciaux.

- Pouvez-vous donner des exemples précis, issus de différents pays, d'applications d'IA responsables et éthiques ?

Professeur Toby Walsh : Un exemple classique est celui des décisions à forts enjeux, comme la détermination des peines aux États-Unis, où un système d’IA est utilisé pour formuler des recommandations sur la durée de la peine d’emprisonnement d’une personne et sur la probabilité de récidive.

Malheureusement, ce système a été entraîné sur des données historiques et reflète involontairement des préjugés raciaux passés qui ont conduit à la discrimination envers les personnes noires. Nous ne devrions pas laisser des systèmes comme celui-ci décider qui est emprisonné.

— Quand une IA commet une erreur, qui est responsable ? Notamment en ce qui concerne les agents IA, avons-nous la capacité de corriger leurs mécanismes de fonctionnement ?

Professeur Toby Walsh : Le problème fondamental des erreurs de l’IA réside dans l’impossibilité de la tenir responsable. L’IA n’est pas humaine, et c’est là une faille de tous les systèmes juridiques du monde . Seuls les humains sont responsables de leurs décisions et de leurs actes.

Soudain, un nouvel « agent », l’IA, apparaît, capable – si nous le lui permettons – de prendre des décisions et d’agir dans notre monde, ce qui pose un problème : qui sera tenu responsable ?

La solution consiste à responsabiliser les entreprises qui déploient et exploitent des systèmes d'IA quant aux conséquences engendrées par ces « machines ».

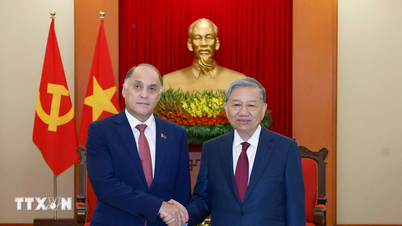

Le professeur Toby Walsh, de l'Université de Nouvelle-Galles du Sud, est intervenu lors du séminaire « L'IA au service de l'humanité : éthique et sécurité de l'IA à l'ère du numérique », organisé dans le cadre de la Semaine des sciences et technologies VinFuture 2025. (Photo : Minh Son/Vietnam+)

De nombreuses entreprises parlent d'IA responsable. Mais comment leur faire confiance ? Comment savoir si elles sont sérieuses et concrètes, et si elles n'utilisent pas simplement l'« IA responsable » comme argument marketing ?

Professeur Toby Walsh : Nous devons accroître la transparence. Il est important de comprendre les capacités et les limites des systèmes d’IA. Nous devrions également « voter par l’exemple », c’est-à-dire choisir d’utiliser les services de manière responsable.

Je suis convaincu que la manière dont les entreprises utilisent l'IA de façon responsable deviendra un facteur de différenciation sur le marché, leur conférant un avantage concurrentiel. Le respect des données clients est essentiel pour une entreprise, car il lui permettra d'attirer et de fidéliser sa clientèle.

Les entreprises finiront par comprendre qu'agir de manière responsable est non seulement éthique, mais aussi gage de leur réussite. J'y vois un moyen de différencier les entreprises, et ce sont les entreprises responsables avec lesquelles nous pouvons faire affaire en toute confiance.

« Si nous n’y prenons pas garde, nous risquons de connaître une période de colonisation numérique. »

Le Vietnam est l'un des rares pays à envisager la promulgation d'une loi sur l'intelligence artificielle. Quel est votre avis à ce sujet ? Selon vous, quels sont les défis éthiques et sécuritaires liés au développement de l'IA pour les pays en développement comme le Vietnam ? Quelles recommandations le professeur formule-t-il pour que le Vietnam atteigne ses objectifs stratégiques en matière d'IA : devenir un chef de file régional et mondial dans la recherche et la maîtrise de l'IA ?

Professeur Toby Walsh : Je suis ravi que le Vietnam soit l’un des pays pionniers à se doter d’une loi dédiée à l’intelligence artificielle. C’est important car chaque pays a ses propres valeurs et sa propre culture et a besoin de lois pour les protéger.

Les valeurs et la culture vietnamiennes diffèrent de celles de l'Australie, de la Chine et des États-Unis. On ne peut attendre des entreprises technologiques chinoises ou américaines qu'elles protègent automatiquement la culture et la langue vietnamiennes. Le Vietnam doit prendre l'initiative de les préserver.

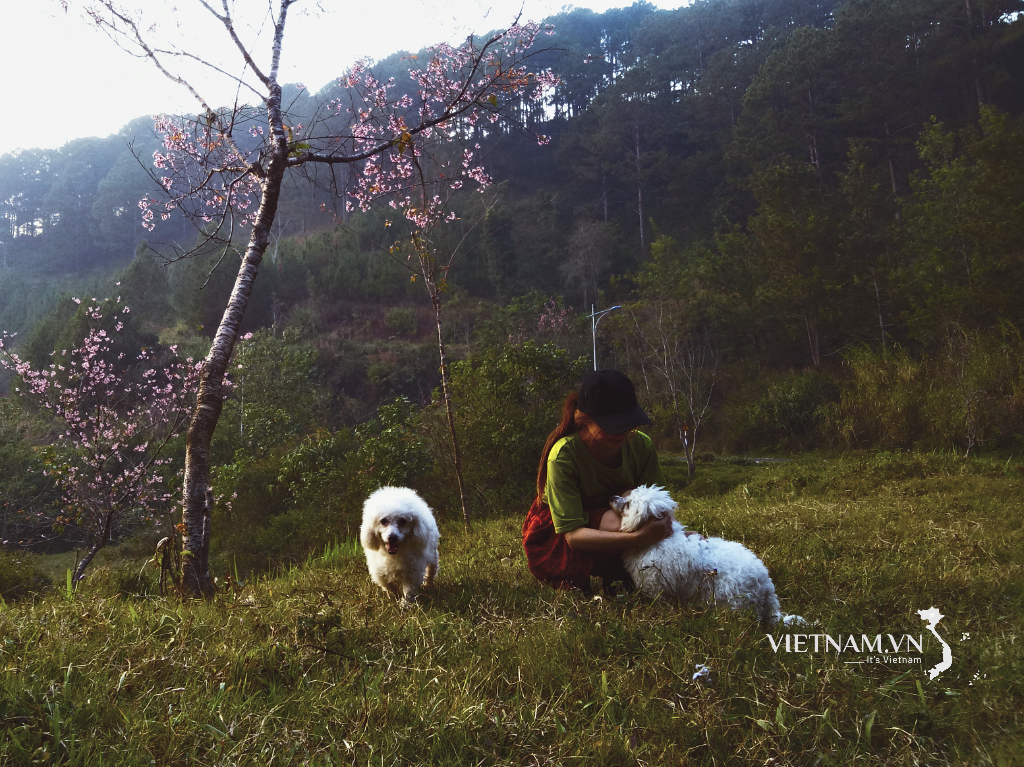

Le professeur Toby Walsh met en garde : si nous n’y prenons pas garde, nous pourrions connaître une période de colonisation numérique. (Photo : Minh Son/Vietnam+)

Je suis conscient que, par le passé, de nombreux pays en développement ont subi une colonisation physique. Si nous n'y prenons garde, nous pourrions connaître une « colonisation numérique ». Vos données seront exploitées et vous deviendrez une ressource bon marché.

Ce risque est menacé si les pays en développement développent l'industrie de l'IA d'une manière qui se contente d'exploiter les données sans contrôler ni protéger leurs propres intérêts.

— Alors, comment surmonter cette situation, Professeur ?

Professeur Toby Walsh : C’est simple, il faut investir dans le capital humain. Développer les compétences des individus, s’assurer qu’ils maîtrisent l’IA. Soutenir les entrepreneurs, les entreprises et les universités spécialisées en IA. Soyons proactifs. Au lieu d’attendre que d’autres pays nous transfèrent des technologies ou nous guident, nous devons prendre les devants et nous approprier ces technologies.

Plus important encore, nous devons plaider fermement pour que les plateformes de médias sociaux créent un environnement sûr pour les utilisateurs au Vietnam, sans pour autant porter atteinte à la démocratie du pays.

En réalité, il existe de nombreux exemples de la manière dont le contenu des médias sociaux a influencé les résultats électoraux, divisé des pays et même incité au terrorisme.

L'intelligence artificielle est très développée au Vietnam. Ces derniers temps, le pays a mis en place de nombreuses politiques pour promouvoir l'IA, mais il est également confronté à un problème : la fraude liée à l'IA. Dès lors, selon le professeur, comment le Vietnam devrait-il gérer cette situation ?

Professeur Toby Walsh : Pour les particuliers, le plus simple est de vérifier l’information. Par exemple, lorsqu’on reçoit un appel ou un courriel, d’une banque par exemple, il faut vérifier : on peut rappeler ce numéro ou contacter directement la banque. De nos jours, les faux courriels, les faux numéros de téléphone et même les appels Zoom peuvent être falsifiés. Ces arnaques sont très simples, peu coûteuses et rapides.

Dans ma famille, nous avons aussi notre propre système de sécurité : une « question secrète » que seuls les membres de la famille connaissent, comme le nom de notre lapin. Cela permet de garantir que les informations importantes restent confidentielles et ne soient pas divulguées.

- Merci beaucoup./.

Le professeur Toby Walsh est chercheur honoraire ARC et professeur Scientia en intelligence artificielle (IA) à l'Université de Nouvelle-Galles du Sud à Sydney (UNSW). Il milite activement pour la mise en place de limites à l'IA afin de garantir qu'elle contribue à améliorer la vie des gens.

Il est également membre de l'Académie australienne des sciences et figure sur la liste internationale des « personnes influentes dans le domaine de l'IA ».

(Vietnam+)

Source : https://www.vietnamplus.vn/doanh-nghiep-su-dung-ai-co-trach-nhiem-se-mang-lai-loi-the-thuong-mai-post1080681.vnp

![[Photo] Vénération de la statue de Tuyet Son - un trésor vieux de près de 400 ans à la pagode Keo](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[Photo] Défilé pour célébrer le 50e anniversaire de la fête nationale du Laos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

Comment (0)